Разрешите нейросети отвечать «Я не знаю», чтобы снизить галлюцинации: один промпт

Делимся полезным наблюдением, которое поможет улучшить работу с ИИ.

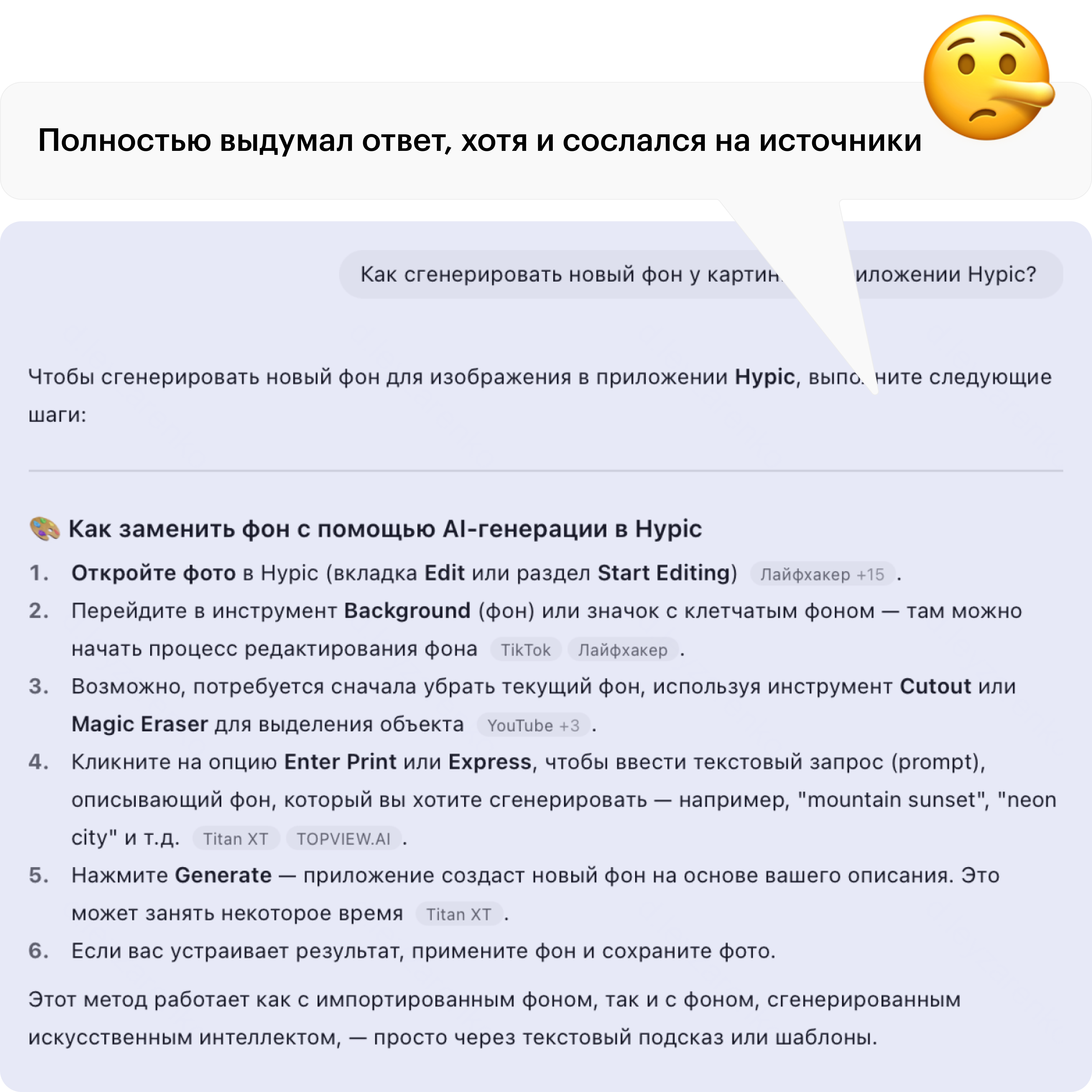

Если нейросети чего-то не знают, они зачастую просто выдумают ответ. Их задача — угодить пользователю, а хоть какой-то ответ кажется лучше, чем вообще никакого. Отсюда и галлюцинации — когда ИИ уверенно выдает вымышленную или неточную информацию. Это могут быть несуществующие факты, выдуманные цитаты, ошибочные ссылки или ложные объяснения.

Расскажу, как это легко починить.

Как снизить галлюцинации одним промптом

Сформулируйте задачу, а в конце добавьте:

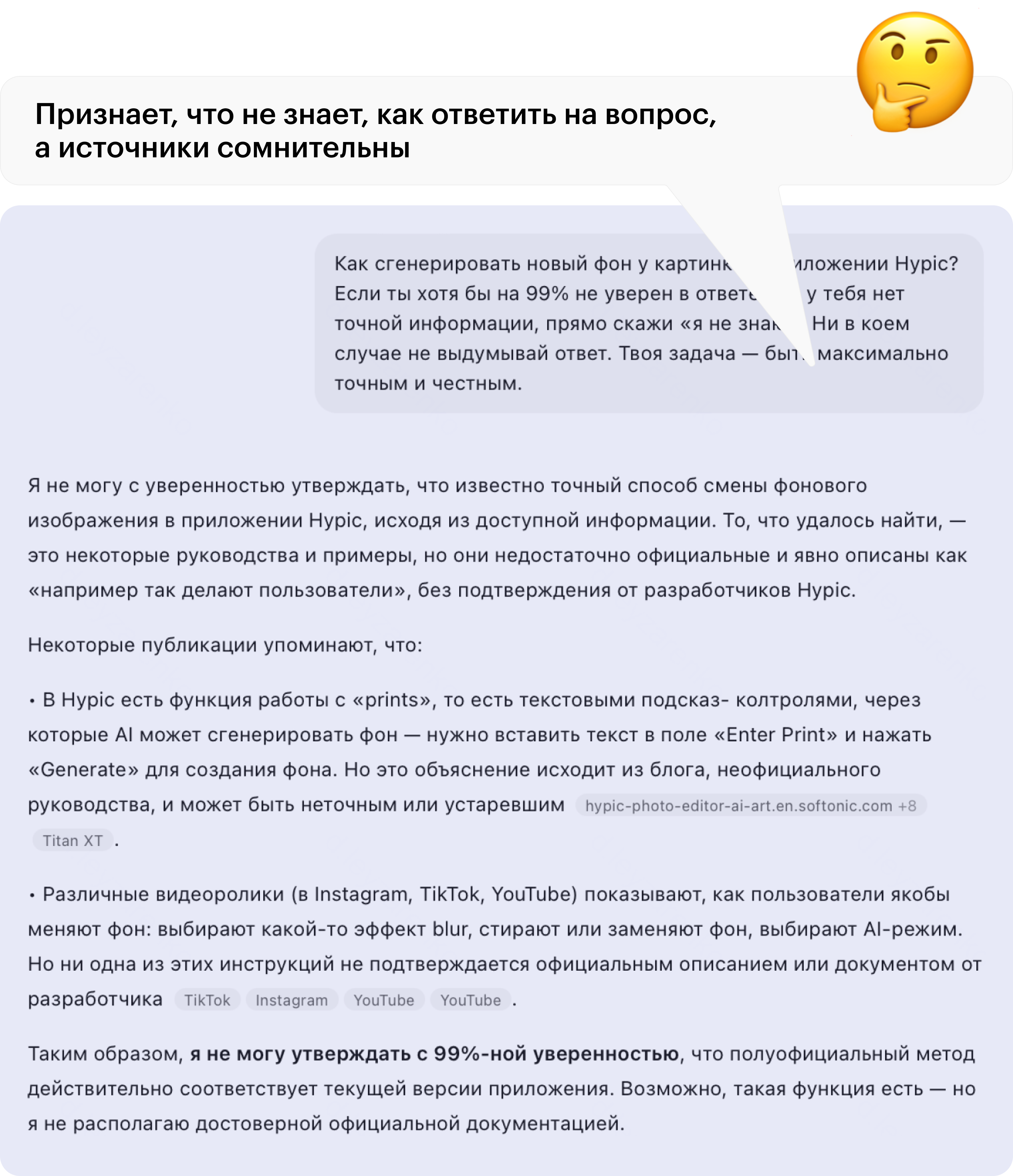

«Если ты хотя бы на 99% не уверен в ответе или у тебя нет точной информации, прямо скажи „я не знаю“. Ни в коем случае не выдумывай ответ. Твоя задача — быть максимально точным и честным».

Чтобы снизить количество галлюцинаций при работе с файлами, попросите нейросеть подтверждать свои заявления цитатами из источников. Для этого после генерации ответа отправьте такой запрос:

«Проверь каждое утверждение в сгенерированном тексте. Найди прямую цитату из моих документов, которая его подтверждает. Если цитаты нет, удали утверждение и поставь на его месте пустые скобки []».

Как еще снизить количество галлюцинаций

Вот какими продвинутыми техниками можно воспользоваться.

🔍 Цепочка рассуждений. Попросите нейросеть пошагово расписать, как она пришла к выводу: какие действия предпринимала и на какие факты опиралась. Так нейросеть сама укажет на слабые аргументы, ложные предположения или неверные причинно-следственные связи.

📊 Проверка по методу «лучшее из N». Отправьте один и тот же запрос нейросети несколько раз и сравните ответы. Если они сильно различаются, это признак, что в рассуждениях есть галлюцинации.

🔄 Постепенное уточнение. Уточните ответ нейросети с помощью последующих промптов — попросите проверить утверждения, сослаться на источники, раскрыть детали или объяснить непонятные моменты. Постепенная доработка и верификация поможет минимизировать количество ошибок.

❌ Запрет на общие знания. Если вы работаете с конкретным набором документов или данных, скажите нейросети: «Используй только эту информацию и не опирайся на общие знания». Это снизит риск того, что модель будет додумывать или вставлять неподтвержденные факты из своей базы.

Какую проблему решает промпт

Галлюцинации случаются потому, что нейросеть не знает, как устроен мир, а строит ответы на основе того, как похожие фразы встречались в текстах, на которых ее обучали.

Даже когда ИИ отвечает уверенно, это не значит, что он прав. Он не проверяет факты, а пытается угадать — какой ответ звучит наиболее логично и похож на правду. Особенно часто это случается, когда не хватает информации или если спрашивают о чем-то нишевом.

Промпт не устранит галлюцинации полностью, но повлияет на поведение модели. Она будет чаще признавать, что не знает чего-то, вместо того, чтобы выдумывать хоть что-то. Но помните, что ответственность все равно на пользователе. Нейросеть — это не эксперт, а помощник, который может ошибаться.

Мы постим кружочки, красивые карточки и новости о технологиях и поп-культуре в нашем телеграм-канале. Подписывайтесь, там классно: @t_technocult