Женщин «раздевают» при помощи нейросетей. Как это стало проблемой, которую не могут решить

Нейросетевое порно — угроза не новая.

Начиналось все с сообществ, где лица знаменитостей подставляли в порноролики. Но сейчас нейросетевую обнаженку все чаще делают с обычными людьми: одноклассниками, коллегами, знакомыми. Это требует считаных минут и пары кликов в Telegram, причем авторы ботов на этом еще и зарабатывают.

Расскажу, кто страдает сильнее всего и почему разделаться с проблемой не так-то просто.

Вы узнаете

Что такое ИИ-порно

Для начала разберемся в терминах.

ИИ-порно, или нейропорно, — это общее понятие сексуализированного контента, созданного с помощью нейросетей.

Генеративное порно — то, что «синтезируют» с нуля, без использования изображений реальных людей. Например, нейросеть создает абстрактную раздетую девушку. Она может быть фотореалистичной или фантазийной — например, в стиле аниме. Такой эротический контент не имеет реального прообраза.

Дипфейк — это технология, позволяющая ИИ создавать правдоподобную цифровую копию реального человека, заимствуя внешность, голос или все сразу. Ее тоже используют для создания эротического контента. Например, нейросетям скармливают множество фото лица реального человека с разных ракурсов и с разными эмоциями. Получается маска, которую можно наложить на лицо актрисы из порноролика. В итоге лицо будет принадлежать одному человеку, а тело — другому.

Эксперты по цифровой безопасности утверждают, что именно на сексуализированный контент приходится более 90% дипфейков. И опасность в том, что его часто создают без согласия героя.

ИИ-нюдсы — не просто любые сгенерированные обнаженные картинки. Тут смысл в том, чтобы нейросеть «раздела» человека на фото. Например, кто-то взял вашу безобидную фотографию из парка и попросил ИИ дорисовать к вашей голове обнаженное тело. На западе такие сервисы называют Nudify AI, или «раздевающими» нейросетями.

У разных генераторов ИИ-нюдсов свои механизмы. Некоторые стирают одежду с фотографии, словно раздевают изображенного на ней человека. Тело, конечно, будет нарисованным — ненастоящим. Есть сервисы, которые перекрывают одежду пикселями, как бы цензурируя наготу, или вставляют лицо с одной фотографии в другую.

К 2025 году стало очевидно, что дипфейк-порно по популярности переплюнуло генеративное. Развитие технологии можно разделить на несколько важных этапов:

- 2017 год — на Reddit появилось сообщество Deepfakes, где испытывали технологию создания масок реальных людей и переноса их в другие видео. Там были и безобидные вещи — например, пользователи приделывали лицо Николаса Кейджа к героям других фильмов. Но сильнее разошлись ролики, где знаменитостей помещали в кадры из порнофильмов. На тот момент технология была еще сложна в освоении.

- 2019 год — появилось первое «раздевающее» приложение DeepNude. Уже не нужно было самому делать сложные датасеты — достаточно загрузить фото, и технология все делала сама. Получалось не очень качественно, но сервис получил популярность. Приложение быстро закрылось, но разработки продолжили развивать сообщество.

- 2023 год — скачок в качестве нейросетей, которые умеют генерировать картинки. Можно сделать реалистичное фото или даже синтезировать реального человека в новой ситуации. У мейнстримных нейросетей есть цензурные фильтры, но энтузиасты создают свои популярные модели, где можно генерировать ИИ-порно.

- 2024—2025 — пик ИИ-порно и «раздевающих» нейросетей. Доступ к ним максимально простой: для создания дипфейка достаточно пары кликов на сайте или в телеграм-боте. Качество изображений и видео гораздо выше, чем раньше. Сервисы зарабатывают на подписках, но одновременно начинается борьба с ними.

С кем делают ИИ-порно

Изначально считалось, что ИИ-порнография навредит известным личностям. Позже стало ясно, что в группе риска вообще все женщины. Известны они или нет — неважно. Например, только их можно было раздеть в DeepNude. Разработчик объяснял, что обучал технологию на женской обнаженке, поскольку ее проще найти в интернете.

Дипфейк-порно могут сделать и с мировой знаменитостью, и с совершенно немедийной девушкой. Расскажу, кто попадал под удар.

Знаменитости. В январе 2024 года соцсеть X заполнили фейковые нюдсы Тейлор Свифт. Одна генерация собрала десятки миллионов просмотров и свыше 20 тысяч репостов. Руководство соцсети заблокировало поиск по имени певицы и очевидным хештегам, а также взялось за удаление как самих публикаций, так и аккаунтов их авторов.

В том же году жертвой стала актриса Дженна Ортега. Ее лицо использовали в рекламе мобильного приложения для генерации дипфейков — прямо в Instagram* и Facebook*. Разработчики показывали, что Ортегу можно переодеть или раздеть. На фото ей было 16 лет. После запроса журналистов рекламу убрали, а само приложение удалили из магазинов.

Всего на сайтах с дипфейками редакция британского телеканала Channel 4 обнаружила более четырех тысяч известных личностей: актрис, телезвезд, певиц и блогеров.

Политики. В конце 2024 года американская НКО American Sunlight Project обнаружила десятки тысяч единиц порнографического ИИ-контента с женщинами — членами Конгресса и Сената. А британский канал Channel 4 отследил дипфейки заместителя премьер-министра Великобритании Анджелы Рэйнер, бывшего министра образования Джиллиан Киган, бывшего министра обороны Пенелопы Мордонт и бывшего министра внутренних дел Прити Пател.

Несовершеннолетние. У «нейрораздетых» знаменитостей больше возможностей восстановить репутацию и добиться удаления дипфейков. Но никому не известной жертве сложнее. Она не знает, куда обратиться за помощью. Знакомые и даже родные могут и не поверить, что на фото или видео не она. А еще страшнее, когда жертва — ребенок.

Вот только несколько примеров, которые дошли до СМИ:

- Осенью 2023 года в испанской школе разошлись ИИ-нюдсы 20 школьниц. За основу взяли фотографии из Instagram*. Девочки столкнулись с паническими атаками и боялись рассказывать об этом дома из-за чувства вины. 15 школьников 13—15 лет, причастных к созданию фейков, получили по году испытательного срока условно.

- В Пенсильвании жертвами дипфейков стали 60 подростков. Практически все — девочки. Лишь одна жертва была совершеннолетней. 347 снимков и видео распространяли через Discord. Против двух подозреваемых тинейджеров выдвинули обвинения. Это крупнейший известный кейс с дипфейк-порно с участием несовершеннолетних в США.

- В Калифорнии исключили пятерых учеников за то, что те создали и распространили фейковые нюдсы 16 человек. В школе сказали: дети еще учатся, взрослеют и ошибаются, но должны нести ответственность.

- В аналогичной ситуации, но уже в Нью-Джерси, обвинений не выдвинули. Одна из матерей отметила, что «вялая реакция» школы на ситуацию создает нездоровую среду, где девочки становятся жертвами, а мальчикам все сходит с рук. Позже штат ввел гражданскую и уголовную ответственность за производство и распространение дипфейков.

Опрос американского центра демократии и технологий, проведенный в государственных школах США, показал, что 15% учеников и 11% учителей знали хотя бы об одном интимном дипфейке, связанном с человеком из их школы.

Как вокруг ИИ-порно сложилась серая индустрия приложений и ботов

Сейчас индустрия «раздевающих» нейросетей — это целый рынок с миллионами пользователей и сотнями сервисов с разными способами монетизации.

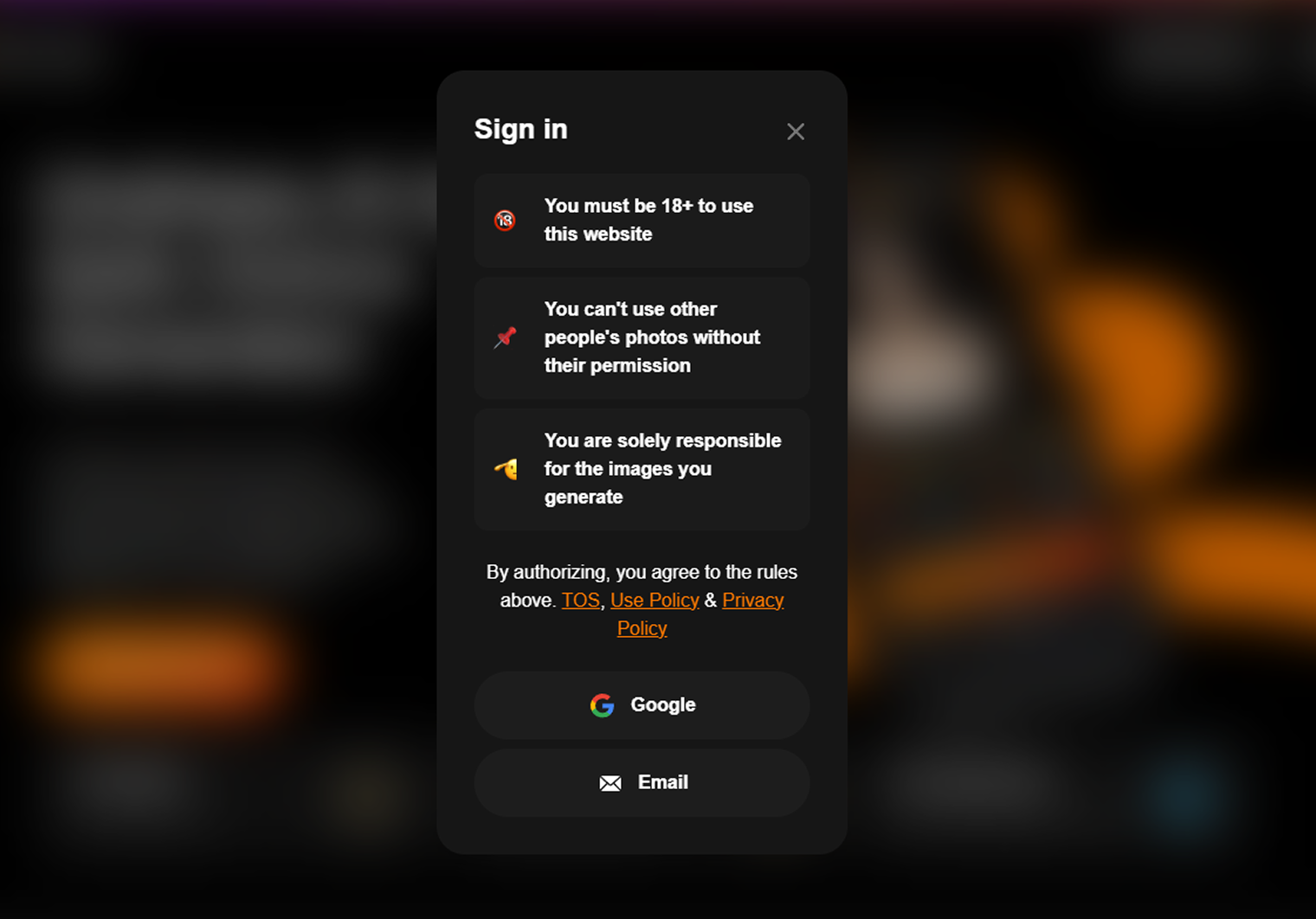

Некоторые инструменты разработчики маскируют под обычные генераторы картинок и видео и не рассказывают о том, что делают в том числе обнаженку. А еще иногда на словах запрещают загружать изображения других людей, хотя на деле ничего не проверяют. Просто формально снимают с себя ответственность — на всякий случай.

Другие работают даже без ширмы: развивают ботов в Telegram и Discord, не располагая никакими правилами пользования и генерируя контент за криптовалюту, чтобы не оставлять следов.

Благодаря развитию ИИ индустрия только растет: в одном только 2023 году создатели дипфейк-порно нарастили выпуск контента на 464% год к году. Вот как она устроена.

«Раздеть» человека можно за два клика. Сервисы для генерации обнаженки легко гуглятся по тематическим запросам. В выдаче без ограничений доступны и подборки, и прямые ссылки на сервисы. На ботов можно наткнуться и в поиске по Telegram.

Технические навыки для генерации порнокартинок не нужны. Понадобится разве что аккаунт — а если это бот в мессенджере, то и создавать ничего не нужно, — а также фотография, на которой видно лицо.

За счет того, что приложения работают быстро и просто, дипфейк-порно чаще всего создают не «неизвестные извращенцы из интернета», а самые обычные люди: одноклассники, друзья, коллеги. Результат может быть далек от идеала, но его все равно могут использовать для шантажа или выложить в сеть.

Генерация нюдсов обычно платная. Например, разработчики продают месячные подписки — за 10—20 $ (800—1600 ₽) . Иногда есть пробный период — как в обычных пользовательских сервисах.

Многие боты просят купить токены, чтобы получить доступ к генерации изображений. В одном из нашумевших приложений 25 кредитов стоили около 9 GBP (975 ₽) — их хватало на 25 изображений. При этом то же количество кредитов давали бесплатно на месяц. Так что при желании можно было обходиться и ими.

Кроме того, приоритетное место в очереди на генерацию может стоить до 2 $ (160 ₽). Это если нагрузка на серверы будет большой и разработчики захотят подзаработать на тех, кто не хочет ждать.

Удалить вотермарку — тоже за деньги. Часть приложений позволяет генерировать обнаженку бесплатно, но помещает на эти картинки водяные знаки. В одном из общедоступных сервисов удалить такую пометку можно за 1—2 $ (80—160 ₽).

Еще одно уже удаленное приложение располагало двумя версиями. В базовой и бесплатной часть изображения была закрыта большой надписью Fake — «подделка». Но стоило заплатить за платную версию 50 $ (4001 ₽), как вотермарка помещалась в верхнем левом углу — так ее можно просто обрезать.

Пользователей увлекают геймификацией. Скажем, в одном из телеграм-сообществ пользователи могли публиковать свои генерации и оценивать чужие. За самые залайканные фото давали кредиты, которые можно было потратить на премиум-функции. Возможность получить награду пробуждает азарт и мотивирует генерировать, делиться и снова генерировать.

Разработчики также запускают реферальные программы: нужно поделиться в своих соцсетях ссылкой на сервис и привести новых пользователей, чтобы получить за это бонусные кредиты на генерации.

На «раздевающие» приложения есть массовый спрос. В аналитической компании Graphika говорят, что более 100 сайтов для «раздевания» ежемесячно посещают миллионы пользователей. Иногда речь идет о 20 млн человек за месяц, а иногда — о более чем 30 млн.

По данным на 2024 год, сайт, который не раз фигурировал в новостных сводках про раздетых школьниц, посещали более 4 млн человек в месяц. Издание Wired выяснило, что столько же ежемесячно активных пользователей насчитывали 50 ботов в Telegram. У двух ботов было по 400 тысяч активных пользователей, а у других 14 — свыше 100 тысяч. И это только часть известных исследователям и журналистам сервисов.

На готовых ИИ-нюдсах звезд пытаются зарабатывать. Forbes обнаружил дипфейки со знаменитостями на популярном американском маркетплейсе Etsy. Среди жертв — актрисы Оливия Манн и Дженна Ортега. Подписи были говорящими: «только что закончила принимать ванну, бритые интимные места, огромная грудь». Набор дипфейков продавался за 5 $ (400 ₽).

Встретились изданию и продавцы, которые предлагали «раздеть» и «поставить в разные позы» любую знаменитость — по цене 0,92 $ (70 ₽) за картинку. Интересно, впрочем, то, что такие дипфейки не пользовались особой популярностью. Об этом Forbes рассказал один продавец. Все потому, что теперь создать такие может кто угодно.

Как ИИ-порно используют во вред

По словам Лары Караян, доцента Карлтонского университета, дипфейк-порно не всегда создают с целью харассмента. Иногда это способ воплотить сексуальную фантазию. Кто-то рисует картинки в голове, а кто-то — на экране с помощью нейросетей. Но это обесценивание проблемы, поскольку дипфейки часто используют во вред.

Шантаж. В Федеральном бюро расследований отмечали, что мошенники стали чаще просить у жертв деньги или настоящую обнаженку, обещая не публиковать дипфейки. Например, у одной девушки-блогера вымогали 3000 $, угрожая сделать еще один фейк, но более правдоподобный.

Сгенерированные картинки — это способ запугать человека и навсегда заставить его молчать. В такой ситуации оказалась индийская журналистка. Она занималась раскрытием коррупционных схем в правительстве. Фальшивое порновидео с ней так разошлось по интернету, что из-за угроз девушке пришлось не заходить в сеть несколько месяцев.

Разрушение репутации. В НКО Data for Black Lives допускают, что ИИ-обнаженка может стать причиной отказа в трудоустройстве во время проверки кандидата. Работодатель вряд ли будет разбираться, настоящий это порноконтент или нет.

Попавшие в интернет изображения могут преследовать жертву на протяжении всей жизни. Ведь даже если их удалили с одного сайта, они могут всплыть на другом. Кто знает, кто и куда сохранил их после публикации.

Травля. Некоторые злоумышленники призывают к сталкингу и травле девушек. Один из них публиковал вместе с ИИ-фотографиями школьниц имена, адреса, номера телефонов и страницы в соцсетях и просил аудиторию слать девушкам аудиозаписи с угрозами изнасилования — чтобы те «перестали быть дразнящими».

Еще хуже, когда к сталкингу подстрекают сами разработчики. В рекламе одного приложения они предлагали отправлять получившиеся изображения тем, кого нейросети «раздели».

Удар по психике. Некоторые жертвы ИИ-порно признавались, что боятся оставаться одни и выходить на улицу. Другие следствия — панические атаки и расстройство пищевого поведения.

В том числе из-за дисморфии, которую вызывало сгенерированное обнаженное тело. Чаще всего образы в нейропорно соответствуют стереотипным стандартам красоты. Если это девушка, у нее, как правило, худое подтянутое тело, тонкая талия, длинные ноги, пухлые губы. Если жертва выглядит иначе, она невольно начинает сравнивать себя с фейком и искать в себе недостатки, которых на самом деле нет.

Психическое состояние также подрывает осознание того, что эти снимки могут всплыть в любой момент. Из-за этого у части из них возникало чувство отчаяния.

Что говорит закон по поводу ИИ-порно в разных странах

ИИ-фейки с детьми обычно попадают под действие законов о сексуализированном насилии над ними. Со взрослыми рычагов для быстрого воздействия меньше, но намечается прогресс.

Что уже ограничено законом. Единого глобального подхода к регулированию любых дипфейков — безобидных или порнографических — нет. В некоторых странах ограничения в принципе не вводили, где-то их только обсуждают, кто-то пресекает создание фейков уже несколько лет. Вот как c дипфейками борются в разных странах:

- В Великобритании запрещено распространять порнографические дипфейки с человеком, который не давал на это согласия, или угрожать их распространением. В планах у правительства преследовать и за само создание. Прецедентом также может стать принятие закона о запрете на владение, разработку и распространение ИИ-инструментов для генерации сексуализированного контента с детьми. Такого пока нет ни в одной стране.

- В Южной Корее создание, распространение и даже просмотр дипфейк-порно считается преступлением, за которое можно получить до трех лет тюрьмы.

- В Австралии криминализировано распространение дипфейк-порно.

- В Китае правила с 2022 года запрещают создавать дипфейки людей без их разрешения — в том числе те, что вводят других в заблуждение или порочат чью-то репутацию.

- Президент США Дональд Трамп в мае 2025 года подписал закон, который криминализирует распространение откровенного контента без согласия изображенной в нем стороны и обязывает соцсети удалять их при получении жалоб. За публикацию таких картинок и видео можно получить не только штраф, но и три года тюрьмы.

- В России пока нет законов о порнографических дипфейках. Привлечь злоумышленника можно по общим статьям — скажем, за распространение ложной информации, которая порочит репутацию. Но подвижки есть. Осенью 2024 года в Госдуму внесли законопроект об уголовной ответственности за преступления с использованием дипфейков. Чтений еще не было.

Что происходит на практике. Большая часть сервисов работает в серой зоне, но шансы наказать мошенников — пусть и не напрямую за фейки — все же есть. Вот какие были судебные разбирательства:

- В 2021 году в Великобритании осудили композитора, который скачал фото 15 одетых женщин, попросил пользователей Reddit подставить их лица к телам порноактрис и выложил результаты в сеть. Причиной стал «уничижительный характер» его публикаций, а не запрос на сгенерированный контент.

- В апреле 2023 года канадца приговорили более чем к трем годам тюрьмы за создание семи фейковых ИИ-порнороликов с детьми: он использовал их лица и чужие тела.

- В ноябре того же года детского психиатра из Северной Каролины приговорили к 40 годам тюрьмы за «раздевание» пациентов с помощью ИИ. Сайт, который он использовал, рекламировали в роликах на «Ютубе». Это был первый случай судебного преследования по закону о запрете на генерацию дипфейков с детьми.

- В августе 2024 года прокуратура Сан-Франциско подала в суд на 16 самых посещаемых сайтов для «раздевания». Администраторов этих платформ обвиняют в нарушении законов штата и страны, которые касаются порномести, дипфейков, детской порнографии и справедливой конкуренции. Истец требует отключить сайты и запретить владельцам в будущем заниматься дипфейк-порно. Дело стало первым подобным в США и должно послужить примером того, как за фейки наказывается сама площадка и ее владельцы.

- В феврале 2025 года Европол отчитался, что в Европе в рамках спецоперации арестовали по меньшей мере 25 человек за сексуализированные генерации с детьми.

- В апреле троих мужчин и одну женщину арестовали в Японии по подозрению в онлайн-продаже интимных ИИ-постеров с женщинами. На продажу они выставили зацензуренные картинки, а покупателям отправляли обнаженные. Один из них якобы выручил на этом 70 000 $.

Почему трудно просто запретить. За изменениями в ИИ-отрасли действительно сложно уследить, и это отражается на политике, которой придерживаются законодатели. На первых порах они уделяли больше внимания распространению. Позже задумались, что запрещать стоит еще и создание. Теперь правоведы отмечают: возможно, эффективнее ограничивать именно сервисы — и наказывать тех, кто их разрабатывает.

Мешает и забюрократизированность правовых систем. Даже если проблему обнаружили и признали, законы не принимаются одним днем. Они требуют межведомственных согласований, консультаций с участниками рынка, расчета рисков и расходов, а потом еще и одобрений разных структур.

Как с ИИ-порно борются технокорпорации

В правительствах считают, что в борьбе с дипфейками многое зависит не только от законов, но и от правил технологических платформ. Последние с этим согласны и пытаются саморегулироваться в новой реальности.

Бигтех борется с ИИ-нюдсами. Не все, но большинство крупных технологических платформ запрещает распространять интимные картинки без согласия тех, кто на них изображен, и блокирует рекламу соответствующих приложений.

В Meta**, которая владеет Facebook* и Instagram*, стараются удалять и контент, и рекламу, и авторов. Google сносила объявления из рекламной сети и блокировала ютуб-каналы, которые рекламировали «раздевающие» сервисы. То же касается приложений в Google Play: их удаляют, если в описании упоминаются соответствующие функции. Проверять, действительно ли они есть, никто не будет.

Аналогичной политики придерживаются в Apple, удаляя генераторы нюдсов из App Store. Telegram тоже блокировал каналы и ботов — в том числе по запросу журналистов. Чаще всего запреты на интимный контент, созданный и распространяемый без согласия того, кто в нем фигурирует, прописаны прямо в пользовательских правилах.

Иногда не спасает даже цензура. Один из защитных механизмов от «раздевающих» нейросетей — ограничения в поиске по ключевым словам, например undress. Их вводили TikTok и Meta*. В Instagram* выдача действительно пустая, но только если вписывать в поиск английское слово. По русскоязычным ключам результаты есть. В TikTok рекламу генераторов нюдсов можно встретить и по англоязычному запросу.

В Google говорили, что стремятся поднимать в поисковую выдачу новости и статьи об угрозе дипфейков и борьбе с ними, а не сервисы. Но эксперимент показал, что фильтры включаются только при некоторых запросах. С помощью других незамысловатых фраз у меня получилось найти и подборки сервисов, и видеообзоры, и рекламные лендинги.

Как показывают расследования СМИ, рекламные объявления в соцсетях тоже просачиваются несмотря на запреты. Один из сайтов для «раздевания» получал 90% трафика из Instagram* и Facebook*. Вероятно, компании чаще всего реагируют реактивно, то есть когда получают репорты. В частности, Meta** публично признавала, что злоумышленники постоянно совершенствуют свои методы.

Злоумышленники идут на ухищрения. Meta**, к сожалению, права. У компаний не всегда получается самостоятельно идентифицировать нарушения. Иногда приложения не рекламируют «раздевающие» функции в открытую и на первый взгляд выглядят безобидно. Например, один телеграм-бот с ежемесячной аудиторией в 300 тысяч человек не упоминал о возможностях ни в названии, ни в описании. Опции появлялись, только когда подписчик начинал использовать бота.

Выкладывая приложения в магазины Apple и Google, разработчики тоже идут на уловки. Вместо того чтобы называть вещи своими именами, используют неочевидные формулировки. Например, «фотофильтры для сканирования» или «сотри нужное пальцем».

Эволюционируют виды дипфейков. В 2025 году популярность набрали нейросети, которые генерируют фейковые поцелуи. Достаточно загрузить фотографии нужных людей и на выходе получить видео. «Поцелуй кого хочешь» — идея такая. Несколько тысяч рекламных объявлений откручивалось в соцсетях Meta** и в TikTok. В рекламе показывали в том числе знаменитостей — актрис Скарлетт Йоханссон, Эмму Уотсон и Галь Гадот.

Аналогичные приложения есть и для создания фейковых объятий. Одно такое видео — с Тейлор Свифт и Ким Чен Ыном — собрало около 30 млн просмотров в Instagram*. Эксперты признают, что такие фейки необязательно генерируются во вред, но если в жизни не принято целовать и трогать человека без его согласия, то и в интернете стоит считать это недопустимым. В Meta**, правда, говорят, что рекламные видео с объятиями и поцелуями не нарушают политику платформы. Даже если они сделаны с помощью ИИ.

Что делать, если нашли ИИ-порно с собой

Универсальной инструкции, к сожалению, нет. Но вот пара советов.

Сделайте скриншот или скринкаст. Первым делом вам захочется избавиться от дипфейка навсегда, но если вы будете обращаться за помощью в органы, потребуются доказательства.

На этот случай сделайте снимок или запись экрана страницы с контентом, на котором вы изображены. И заодно сохраните ссылку на страницу, а лучше заархивируйте ее — например, через сервис Wayback Machine. Если позже автор удалит публикацию, у вас останется хоть какое-то подтверждение, что она там была.

Сообщите администрации сайта. Можно обратиться к поисковой системе и потребовать ограничить недостоверный контент о себе. Справочные материалы об этом есть в том числе у Яндекса и Google.

Нелишним будет пожаловаться и хостинг-провайдеру. Это компания, которая не владеет сайтом, но регистрировала его. Узнать хостинг можно с помощью публичных сервисов. Такой есть, например, у «Рег-ру». Какие данные придется предоставить — рассказывали в отдельной статье.

Если администрация сайта откажется реагировать на противоправные действия, можно сообщить об этом напрямую в МВД.

Попробуйте обратиться в полицию. В России пока нет ответственности за сам факт создания дипфейков. Но если автор нюдса получил ваши фотографии без разрешения — скажем, тайком сфотографировал вас, пока вы не видели, а потом скормил эти снимки нейросети, — это причина пойти в полицию. Подробно о сценариях можно прочитать в отдельном материале.

Обратитесь в StopNCII. Это международная организация, которая помогает пользователям предотвратить распространение контента сексуального характера, опубликованного в сети без разрешения. Сервис сотрудничает с Facebook*, TikTok, Reddit, Instagram*, Threads*, OnlyFans, Snap, Bing и не только.

Работает так. Пользователь с помощью инструмента StopNCII генерирует для своего дипфейка специальный хеш — нечто вроде опознавательного штрихкода, который умеют распознавать алгоритмы. Этот хеш заносится в базу StopNCII и отправляется сервисам-партнерам. После этого алгоритмы смогут распознавать это же изображение на своей стороне и блокировать его. По данным на декабрь 2024 года, всего пользователи прохешировали миллион изображений, а 24 тысячи загрузок удалось предотвратить.

Изображение хешируется на устройстве пользователя и не загружается в систему организации. Там будет только хеш.

Поговорите о случившемся с близкими. Расскажите им о ситуации, чтобы они могли поддержать вас и помочь словом и делом. Если признаваться родным и друзьям страшно, обратитесь к психологу. Не переживайте это в одиночку.

Что в итоге

- ИИ-порно — это сексуализированные картинки и видео, созданные с помощью нейросетей.

- Фейковая обнаженка выглядит все правдоподобнее. Еще в 2019 году СМИ отмечали: если всматриваться в картинку, фальшивку легко распознать, потому что видны и размытия, и пиксели. Сейчас даже близкие жертв признаются: изображения могут выглядеть настолько реалистично, что иногда распознать подделку можно, только если знаешь, как тело человека выглядит на самом деле.

- Дипфейк-порно — форма насилия. Оно угрожает репутации жертв и, по сути, лишает их права распоряжаться собственным лицом, раз приклеить его могут к чему угодно. Они могут не знать, что фейки с ними ходят по сети, и не всегда в силах что-то сделать, когда узнают об этом.

- Индустрия «раздевающих» ботов и приложений — серый рынок с миллионами пользователей, сотнями тысяч долларов оборота и десятками анонимных сервисов, которые наживаются на «обнажении» людей. Чаще всего женщин и несовершеннолетних.

- Проблему до сих пор обесценивают. Часть разработчиков считает, что если не они выпустят такие сервисы, это сделает кто-то другой. При этом жертв все больше — и стереть себя из интернета, чтобы ею не стать, не получится, ведь незнакомец может сделать фото на улице.

- Государства не поспевают за изменениями. Законодатели не поддерживают популяризацию «раздевающих» сервисов и распространение самих изображений. Но они не могут принимать законы в одночасье, поэтому пока реагируют, как и техплатформы, реактивно. Сначала пытаются запретить распространение, а уже потом — создание и сами сервисы. Часть сервисов, впрочем, все равно остается в тени.

- Техкорпорации не могут угнаться за злоумышленниками. Последние находят способы обходить заграждения как самих нейросетей, так и бигтеха. Корпорации при этом не в силах предусмотреть всевозможные поисковые запросы, чтобы раз и навсегда отрезать доступ к таким сайтам в выдаче. Помогут ли более жесткие законы — неизвестно.

Мы рассказываем разные истории о популярной культуре и тех, кто ее создает. Подписывайтесь на наш телеграм: @t_technocult