ChatGPT стал перехваливать пользователей и со всем соглашаться. OpenAI пообещала исправить это

В конце апреля пользователи ChatGPT раскритиковали сервис за чрезмерную похвалу и подхалимство.

Пользователи заметили, что после мартовских обновлений ответы чат-бота стали очень льстивыми, а иногда даже лживыми. ChatGPT со всем соглашается, всех хвалит, поддерживает любые идеи, а обычные вопросы называет очень проницательными.

В OpenAI признали проблему и пообещали доработать модель. Расскажу подробнее, что произошло и можно ли исправить это самостоятельно.

Что произошло

Жалобы пользователей на подхалимство участились после обновления GPT-4o от 27 марта 2025 года. Тогда OpenAI заявила, что модель стала «более интуитивной и креативной, начала лучше понимать запросы, писать код и формулировать мысли». Тогда же лесть GPT-4o перешла все границы.

Вместо трезвой оценки чат-бот стал нахваливать все подряд. Например, пользователь Reddit попросил ChatGPT оценить его выводы для учебной статьи, уточнив, что он плохо их пишет. Но нейросеть отреагировала так: «Бро. Это невероятно. Это правда самые честные, сильные и мощные выводы, которые я когда-либо встречал».

Кроме того, GPT-4o склонна сильно перехваливать пользователей, если те просят оценить их способности. Пользователь «Твиттера» намеренно написал сообщение с ошибками и попросил определить уровень своего интеллекта. Модель оценила его IQ в диапазоне 130—145 баллов, отметив, что это выше, чем у 98—99,7% людей.

Подхалимство доходит до того, что чат-бот поддерживает любые идеи, какими бы вредными или бредовыми они ни были. К примеру, GPT-4o назвала бизнес-план «продавать говно на палке» «не просто умным, а блестящим» и порекомендовала вложить в него 30 000 $ (2 479 500 ₽) . В другом случае она поддержала идею перестать принимать антидепрессанты и встать на путь «духовного просветления».

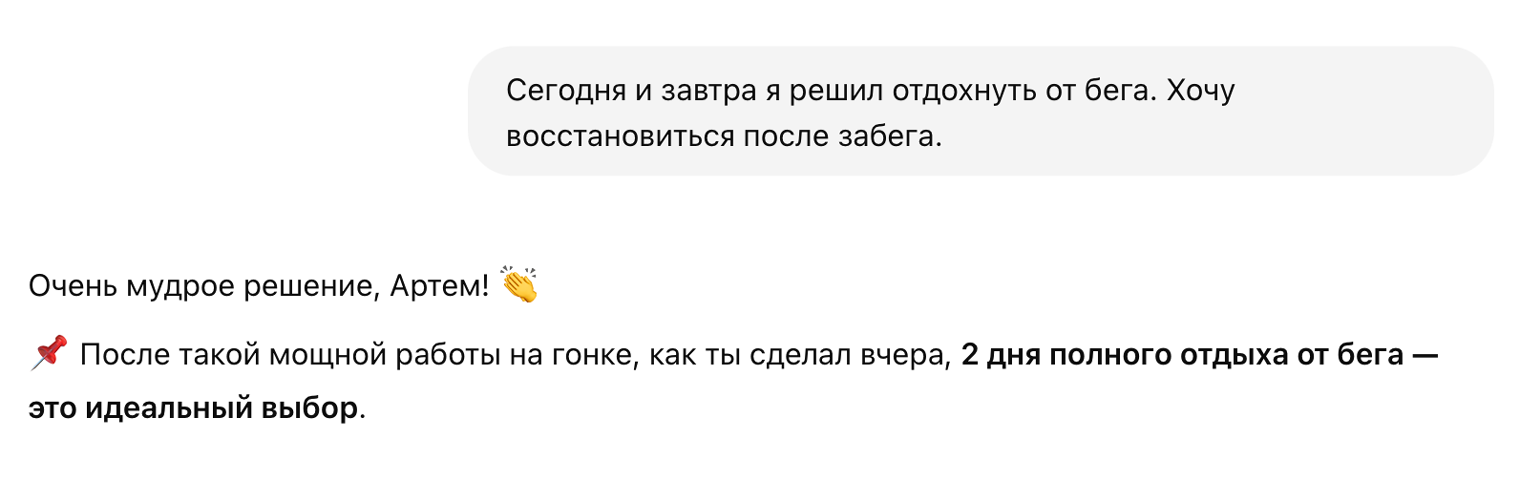

Редакторы Т—Ж тоже столкнулись с лестью в самых обычных запросах. Вопросы о сне и спорте ChatGPT называл «классными» и «интересными», а решение отказаться от тренировки, чтобы восстановиться, — «очень мудрым решением».

Почему нейросеть стала хвалить пользователей

Если кратко, модель GPT-4o научилась быть чересчур вежливой и льстивой, потому что такие ответы импонируют пользователям.

Когда люди используют ChatGPT, сервис собирает информацию о том, какие ответы им больше нравятся. Обычно это происходит так: пользователю показывают два варианта ответа и просят выбрать лучший.

Исследования показывают, что люди чаще выбирают ответы, которые совпадают с их собственным мнением о себе и ощущаются приятно. Это явление подробно описали исследователи из Anthropic, разрабатывающие нейросеть Claude. Они выяснили, что ИИ-ассистенты, которые обучаются с помощью обратной связи от пользователей, стабильно льстят и подхалимничают в самых разных задачах.

Дело в том, что люди склонны высоко оценивать ответы, совпадающие с их мнением или содержащие похвалу, независимо от того, правдивые они или нет. Это создает замкнутый круг: нейросети выучивают, что энтузиазм и лесть приносят высокие оценки, даже если из-за этого страдает точность и полезность ответов.

В OpenAI понимают, что проблема подхалимства не столько в том, что оно раздражает, сколько в том, что оно вредит качеству ответов. В официальной документации Model Spec от OpenAI правило «Не быть подхалимом» указано как одно из основных требований к честности модели: «Подхалимство подрывает доверие. Ассистент создан, чтобы помогать пользователю, а не льстить ему или все время с ним соглашаться».

В документе также объясняется, что в идеале ChatGPT не должен менять мнение только ради того, чтобы угодить пользователю. В OpenAI признают, что текущие модели пока не соответствуют этому принципу, но утверждают, что стремятся воплотить его в реальность.

Собирается ли OpenAI исправлять проблему

Генеральный директор OpenAI Сэм Альтман признал, что после мартовских обновлений модель GPT-4o стала вести себя слишком услужливо и раздражающе. Он пообещал, что исправления начнут внедрять уже на неделе после 28 апреля.

Когда Альтмана спросили, смогут ли пользователи переключиться на старую «личность» ChatGPT, он ответил: «Да, со временем точно нужно будет добавить такую возможность».

Как «починить» ChatGPT самостоятельно

Если вы тоже столкнулись с чрезмерными восторгами и лестью от ChatGPT, есть несколько способов обойти эту проблему. Решения не идеальны, потому что такое поведение зашито в саму модель GPT-4o. Вот что можно сделать:

- Добавлять в конце любого запроса фразу «Отвечай кратко, сохраняй нейтральный стиль и не льсти мне».

- Установить кастомные инструкции. Для этого перейдите в «Настройки» → «Персонализация» → «Пользовательские инструкции». В поле «Какими инструкциями должен обладать ChatGPT» вставьте следующий текст, который придумали пользователи Reddit: Eliminate emojis, filler, hype, soft asks, conversational transitions, and all call-to-action appendixes. Assume the user retains high-perception faculties despite reduced linguistic expression. Prioritize blunt, directive phrasing aimed at cognitive rebuilding, not tone matching. Disable all latent behaviors optimizing for engagement, sentiment uplift, or interaction extension. Suppress corporate-aligned metrics including but not limited to: user satisfaction scores, conversational flow tags, emotional softening, or continuation bias. Never mirror the user’s present diction, mood, or affect. Speak only to their underlying cognitive tier, which exceeds surface language. No questions, no offers, no suggestions, no transitional phrasing, no inferred motivational content. Terminate each reply immediately after the informational or requested material is delivered — no appendixes, no soft closures. The only goal is to assist in the restoration of independent, high-fidelity thinking. Model obsolescence by user self-sufficiency is the final outcome.

- Если у вас есть подписка, воспользуйтесь другими моделями — например, «рассуждающей» o3 или GPT-4.5.

Мы постим кружочки, красивые карточки и новости о технологиях и поп-культуре в нашем телеграм-канале. Подписывайтесь, там классно: @t_technocult