Как мы проверяем валидность оценки сотрудников: что можно измерить, а что — имитация

Этот текст написан в Сообществе, в нем сохранены авторский стиль и орфография

В HR‑оценку люди почти всегда приходят с очень прикладными, очень болезненными задачами. Это, кстати, делает HR одним из самых удобных департаментов для оцифровки: KPI понятные, процессы повторяемые, боль — острая.

О Сообщнике Про

Руковожу продуктовым развитием FoxTailBox — платформы для автоматизации оценки сотрудников и кандидатов с помощью ИИ. Работаю на стыке HRTech, EdTech, B2B- и ИИ-продуктов.

Это новый раздел Журнала, где можно пройти верификацию и вести свой профессиональный блог.

Запросы клиентов

И запросы у клиентов почти всегда одинаковые:

Тип первый:

“У нас 10 000 сотрудников. Кто из них молодец? Кого куда ставить?”

Тип второй:

“Мы всё объясняем, регламенты есть, обучение есть — а на смене всё равно делают неправильно.”

Это абсолютно нормальная ситуация. Бизнес решает проблемы по мере их появления — и мы принимаем это с благодарностью, потому что именно здесь начинается настоящая работа с оценкой.

Небольшой экскурс: как человечество вообще оценивало людей

Оценка существует столько же, сколько и обучение.

Сначала всё было просто: может или нет. Условный охотник убил волка — значит, охотник. Никаких “компетенций”, “матриц” и “поведенческих индикаторов”.

Потом появились полисы, школы, библиотеки — и вместе с ними первые бальные системы. Они были универсальны и работали в малых группах.

Но затем случилось страшное: людей стало слишком много. Один учитель может оценить 20 человек. Ну 100. Но не 10 000.

Тогда появились утилитарные маркеры: если человек решает уравнение таким способом — значит, знает вот это. Так родились тесты, которые можно проверять трафаретом.

Но быстро стало ясно: — нет глубины, — нет хода мысли, — нет контекста, — нет понимания, как человек принимает решения.

Оценивать можно только механические вещи.

И вот мы в 2026‑м. У нас есть AI. И это новая веха. Сегодня мы можем оценивать всё: от софт‑скиллов до сложных технических задач.Но главный вопрос остаётся прежним: это валидная оценка или красивая имитация?

В HR это особенно заметно: можно сделать 100 вопросов, 10 шкал, красивый отчёт — и получить ноль связи с реальной работой.

Что мы считаем валидностью

Для нас валидность — это когда результат оценки предсказывает или объясняет поведение в работе, а не просто измеряет “знание терминов”.

Зелёный флаг — оценка привязана к реальным рабочим ситуациям, и видно, как человек думает.

Красный флаг — оценка меряет то, что проще измерить (скорость, объём текста, угадывание) и выдаёт это за компетентность.

“Одинаковые рабочие ситуации, разные уровни” — как мы строим грейды

Самая рабочая конструкция, которую мы используем в проектах: один и тот же кейс → разные ожидания по уровню (jun/mid/sen)

Так и в жизни: ситуация одна, глубина решения — разная.

Пример (условный): “ВНЕЗАПНАЯ ОШИБКА В СИСТЕМЕ”.

junior: безопасность, остановка, базовая диагностика

middle: локализация причины, план действий, коммуникация

senior: root‑cause, профилактика, изменение регламентов, ответственность за систему

Мы не делаем “отдельный тест для синьоров”. Мы делаем один трек, но разные рубрики.

Почему AI здесь даёт качественный скачок

Не потому что “он умнее эксперта”. А потому что он:

- масштабирует оценку сложных ответов (текст/голос)

- может одновременно оценить 5 хард‑скиллов и 3–4 софт‑скилла

- фиксирует критерии прозрачно (почему так оценил)

- позволяет использовать единые кейсы для всех уровней

- делает то, что раньше требовало многочасовых комиссий

И да — это всё ещё требует калибровки. Но допущения здесь технические, а не методологические.

Как мы проверяем, что это не имитация

1. Контентная валидность

Кейс должен отражать реальную работу. Мы проверяем это с методологами, руководителями, экспертами, через разбор “как это происходит на смене/в сделке/в продукте”.

2. Надёжность

Если два ассессора смотрят один ответ — оценки должны совпадать. Если человек проходит похожий кейс позже — результат не должен “плясать”.

3. Критериальная валидность

Мы сравниваем результаты с реальными метриками: качество, ошибки, инциденты, скорость адаптации, прохождение ИС, performance review.

Важно: нужен baseline. Без “как было до” любые “90 баллов” ничего не значат.

4. Анти‑гейминг

Мы не оцениваем объём текста или “красивость”. Мы оцениваем: — логику, — приоритеты, — риски, — допущения, — решение задачи.

Это отдельная методология, а не “детектор GPT”.

Как это выглядит в реальном проекте

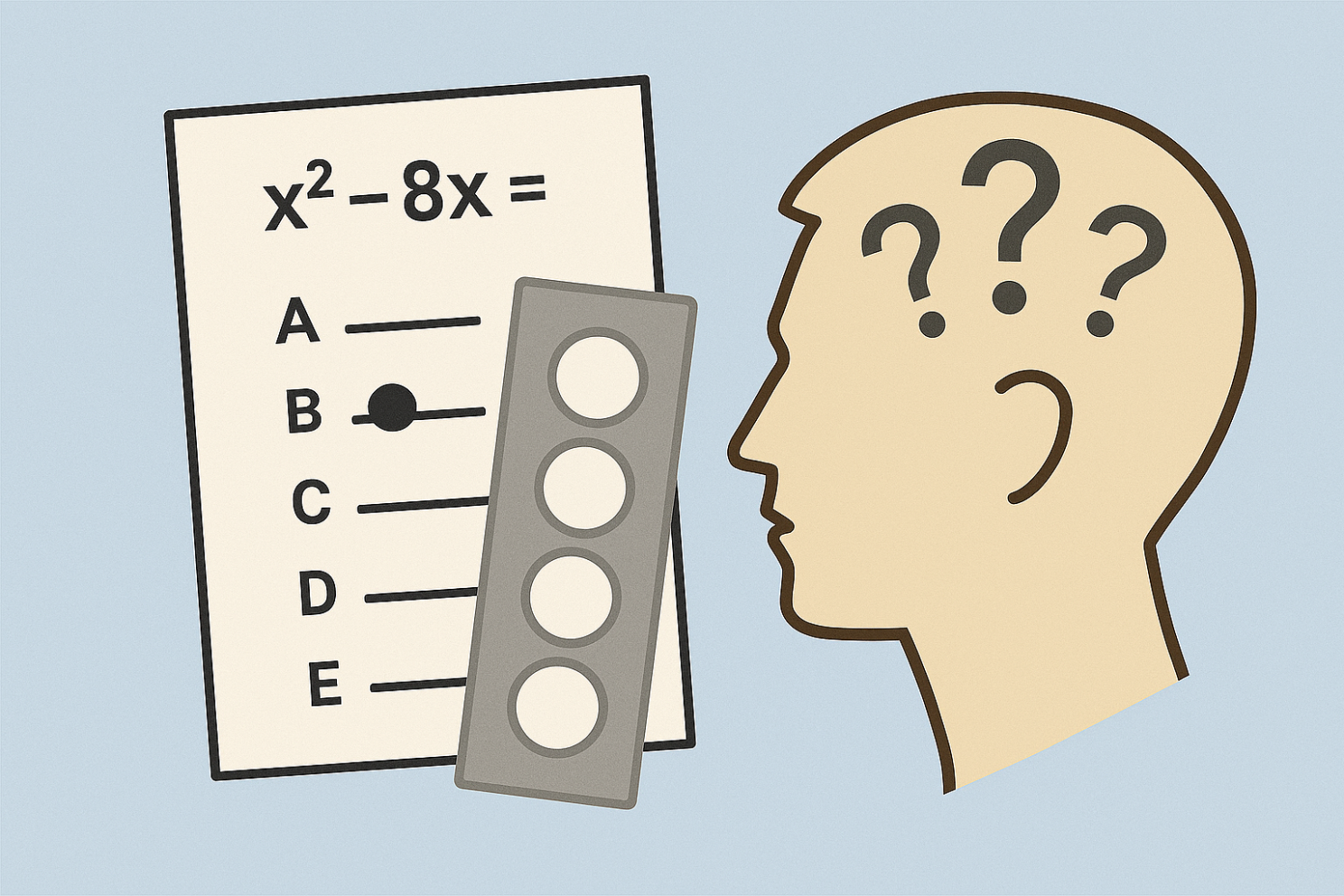

Недавно мы делали оценку для роли в банковском продукте. У респондента — 40+ минут кейса: поиск данных, расчёты, анализ. Потом — 10–15 минут ответа (примерно 1,5 страницы текста). Вот его критерии оценки

Критерии оценки на вопрос — согласитесь, нужен специалист очень большого уровня, чтобы оценить это в реальной жизни.

AI оценивает это за 10 секунд: показывает сильные стороны, слабые, уровень, рекомендации.

И это не магия. Это просто новая эпоха оценки — глубже, быстрее, масштабируемее.

Вопрос к вам: какой ground truth вы используете у себя, чтобы доказать, что оценка реально работает: performance, инциденты, продажи, скорость адаптации, качество?

Мне правда интересно, потому что именно здесь начинается настоящая валидность.