ИИ-слоп: почему низкокачественный контент нейросетей убивает интернет и бесит пользователей

Нейросети породили огромное количество контента сомнительного качества.

У ИИ есть свои плюсы, но низкий порог вхождения и ленивый подход к промптам привели к «замусориванию» интернета. Сайты превратились в заводы ИИ-контента, паблики фармят реакции на картинки с бабушками, а люди используют галлюцинации нейросетей в спорах. Все вместе это называют ИИ-слопом. Расскажу, откуда пошел термин и почему он с нами надолго.

Что такое ИИ-слоп

В английском языке слово slop означает водянистую или кашеобразную смесь, такую как корм для свиней или кухонные отходы. Со временем оно стало сленговым обозначением всего некачественного и сделанного наспех. В интернет-культуре слово slop начали использовать (сайт недоступен из РФ) для описания халтурного контента еще до появления нейросетей.

По мере популяризации ИИ интернет начал заполняться генеративным контентом сомнительного качества. Причины на то были разные. Например, обычные пользователи тестировали нейросети и делились тем, что получалось, в интернете. Но их результаты были не очень хорошими из-за отсутствия опыта. Контент-фермы сделали ставку на ИИ, чтобы быстро производить статьи и картинки.

Из-за масштабов и отношения к аудитории контент оказывался ленивым: неотредактированные тексты, ошибки и артефакты. Но неподготовленные пользователи принимали на веру даже такое.

А еще появилось много так называемых быстрых трендов с использованием ИИ. Самый известный — с картинками в стиле студии Ghibli, созданными в ChatGPT. Так генеративный контент стал не только массовым, но и однообразным. В сообществе обсуждали, как это назвать: AI garbage («ИИ-мусор») или AI pollution («ИИ-загрязнение»). Но в итоге к уже устоявшемуся термину slop добавили приставку AI.

ИИ-слоп — любой некачественный контент, по которому сразу видно, что он сгенерирован нейросетью.

Термин закрепился во второй половине 2024 года. К тому времени сервисы для генерации текста, картинок, видео и музыки стали использовать не только энтузиасты, но и вообще все. Из-за этого ИИ-контента резко стало больше.

В июне 2025 года соответствующее значение слова slop добавили в Кембриджский словарь. А примеры слопа стали собирать в тематических сообществах.

Как интернет наполнился ИИ-слопом

ИИ-слоп бывает разнообразным и может поджидать вас в любом уголке интернета. Расскажу подробнее и покажу самые известные примеры.

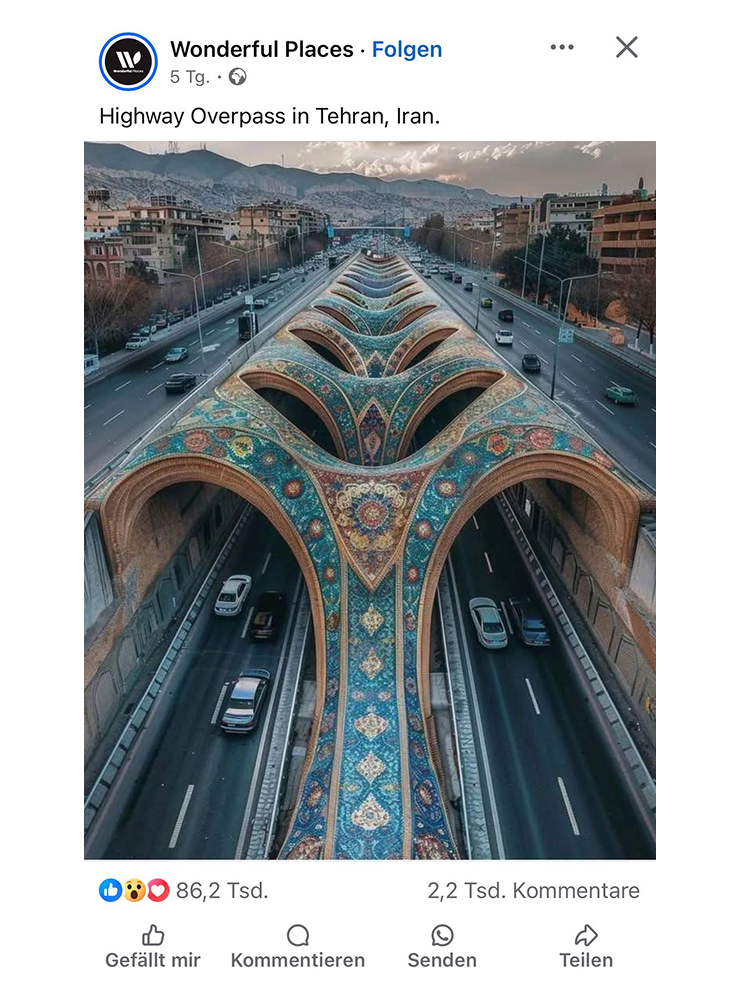

«Желтый» визуал. Весной 2025 года ChatGPT обновил генератор картинок. Стало лучше качество, появилась возможность генерировать по реальному фото и добавлять текст в изображения. Я уже упоминал тренд на картинки в стиле студии Ghibli — эта волна началась как раз с обновления ChatGPT.

Картинки стало создавать легче, чем когда-либо. Достаточно в общих чертах описать, что нужно нарисовать и какие слова вставить. Также появилось множество готовых промптов.

В результате соцсети заполонили ИИ-иллюстрации. Причем пользователи редко прописывали уникальные визуальные приемы в промптах, поэтому ChatGPT оставлял «дефолтную» стилистику. В итоге с изображений смотрят одни и те же люди, слова набраны одним и тем же шрифтом, а фирменная «желтизна» стала одним из маркеров слопа.

А ведь многие бесплатные нейросети для картинок еще хуже. Они рисуют по семь пальцев на руках, одинаково копируют аниме-эстетику, оставляют видимые артефакты. И в таком виде изображения используют в коммерческих целях — чтобы удешевить или ускорить работу, — за что брендам то и дело достается. Например, в марте 2025 года разгорелся скандал из-за обложки новой книги про Ведьмака: читатели пришли к выводу, что ее сделали при помощи нейросети, и потребовали отказаться от слопа.

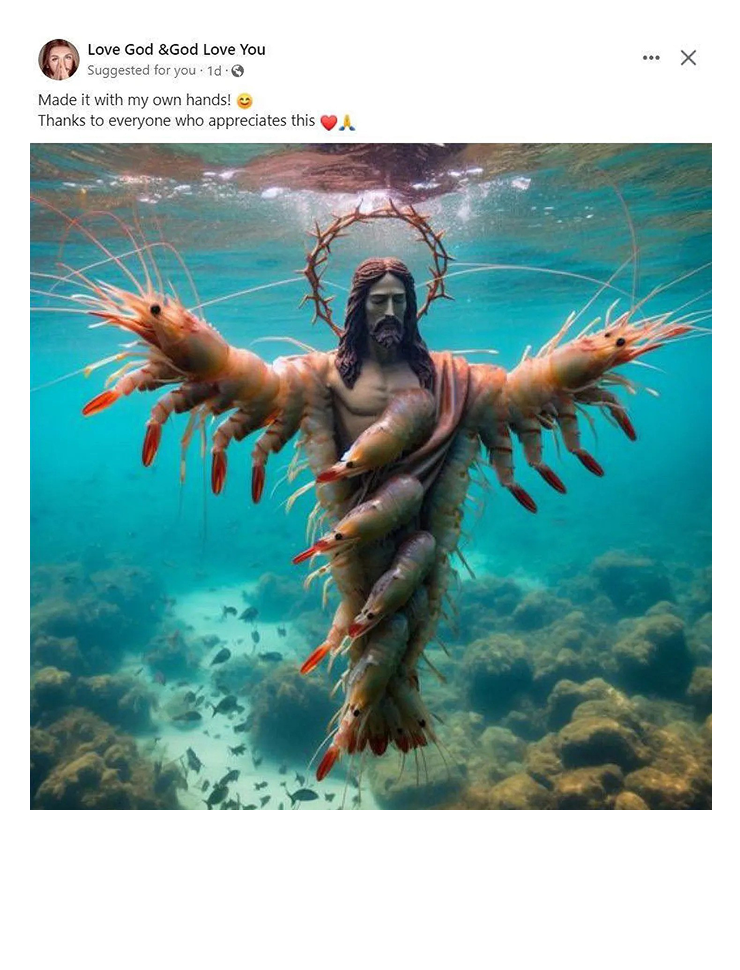

Креветочный Иисус и другие «чудеса». В 2024 году «Фейсбук»* наводнили сгенерированные картинки, которые постили с одной целью — набрать просмотры и охваты, чтобы заработать на партнерской программе. Основная аудитория таких пабликов — доверчивые пожилые люди.

В таких постах либо давят на жалость, либо пытаются вызвать чувство восхищения. Мол, посмотрите, африканский мальчик своими руками собрал машину из пластиковых бутылок. Абсурдные сюжеты вовсе не смущали авторов, даже наоборот. Так дошло до Иисуса из креветок: паблики пытались убедить пенсионеров в «очередном чуде», а религиозная тематика только сыграла на руку.

ИИ-слоп — это не только визуальный контент. Контент-фабрики, сайты, медиа и блогеры уже создают тексты с помощью нейросетей. Слопом это становится, когда автор не уважает свою аудиторию и, например, публикует сгенерированные тексты без какой-либо редактуры, проверки фактов или добавления чего-то «человеческого».

Одной из платформ, пострадавших от текстового ИИ-слопа, стал LinkedIn. Там появилось множество «экспертных» статей, которые на самом деле написал ChatGPT. Причем обычно это очевидно по стилистике: обтекаемые фразы, много общих слов, минимум конкретики, одни и те же формулировки, нет живых примеров. Появились даже браузерные расширения вроде LinkedIn AI Slop Detector.

Конвейерные тренды. Во второй половине 2024 года генерировать видео стало намного проще и дешевле. Тогда ИИ-слопом активно занялись контент-фермы, о которых я уже упоминал. Немного объясню технологию масштабирования нейроконтента.

Контент-ферма видит популярный ролик, сделанный человеком в нейросети, и повторяет его с небольшими изменениями. А потом повторяет еще, и еще, и еще. Так появляется множество видео с рыдающими котами в драматичных ситуациях под «мяу-мяу-мяу»-каверы на песню Билли Айлиш. Контент-ферма может выпустить 5—10 таких роликов в надежде, что один из них точно залетит.

В конце концов нейросети научились не только генерировать видео, но и подставлять к нему готовую аудиодорожку. Особенно реалистичные ролики стали получаться с помощью Veo 3 от Google. После выхода модели соцсети заполонили видео сгенерированных уличных интервью, в которых бабушки выгуливают бегемотов, жирафов и других экзотических животных.

Если в историю про бабушку с бегемотом поверить сложно, то есть и более правдоподобные примеры. Например, видео с кроликами, прыгающими на батуте, собрало более 200 млн просмотров в соцсетях. Поскольку ролик сгенерирован с эффектом камеры наблюдения, да еще и в ночном режиме, ряд артефактов остались незамеченными. Многие пользователи, смотревшие видео с экрана телефона, так и не заметили подвоха.

Апелляция к авторитету ИИ. Нейросети до сих пор допускают ошибки в ответах. Причем иногда они с очень уверенным видом несут ерунду — это называют галлюцинациями. А еще они склонны подстраиваться под пользователя, чтобы угодить ему. При этом многое зависит от постановки вопроса, особенно в спорных темах: два человека могут спросить об одном и том же разными способами и получить две абсолютно разные точки зрения. Все это влияет на доверие к контенту нейросетей.

Но это не мешает людям использовать ИИ в качестве аргумента в спорах. Обычно такие собеседники либо прямо цитируют ответ ChatGPT без критического осмысления, либо вообще просто кидают скриншот. В соцсети X, бывшем «Твиттере», мемом стала фраза «@grok, это правда?»: так пользователи призывают нейросеть Grok в любую переписку.

В итоге Grok стал одновременно авторитетом, которого пытаются переманить на свою сторону, и последним аргументом в споре. В то же время сама нейросеть отвечает настолько противоречиво, что может занять совершенно разные позиции в рамках одного треда.

Что плохого в ИИ-слопе

ИИ-слоп делает более правдоподобной теорию мертвого интернета. Это такая метафора о том, что интернет становится все менее живым и более корпоративным. Большую часть контента создают не люди, а алгоритмы, заточенные под коммерческие интересы и удержание внимания, а не под искреннее общение или обмен идеями.

Вот как ИИ-слоп способствует «убийству» интернета:

- «Замусоривание». Людям становится сложнее находить качественные и разнообразные материалы. Приходится тратить больше времени и усилий, чтобы в потоке ИИ-слопа найти «человеческую» информацию. Колумнистка The Atlantic даже сыронизировала, что ИИ-слоп поможет победить интернет-зависимость, потому что сидеть в сети станет настолько неприятно, что люди вернутся в реальный мир.

- Фейки. ИИ-слоп может вводить в заблуждение доверчивых людей: распространять дезинформацию, ошибочные советы или опасные рекомендации. К тому же с развитием моделей для генерации видео и картинок контент становится все реалистичнее.

- Деградация самих нейросетей. Большинство ИИ обучается на данных из интернета. Если там станет больше мусорного контента, модели запомнят его как норму. Со временем они будут хуже отличать качественные материалы от мусорных. Это создаст замкнутый круг, в котором нейросети начнут воспроизводить собственные ошибки и слоп.

- Нормализация низкокачественного контента. Если в интернете появляется куча одинакового и банального ИИ-слопа, аудитория теряет интерес и доверие к площадке, где его публикуют. Так, например, произошло с Pinterest, где по нейтральным запросам вроде «осеннее настроение» или «идеи для ремонта ванной» половина выдачи — с ИИ-картинками.

Кто такие слопперы

ИИ повлиял не только на контент в интернете, но и на поведение людей. Издание Futurism рассказало о «слопперах» — тех, кто на постоянной основе принимает решения на основе советов от ChatGPT, DeepSeek или других чат-ботов.

Яркий пример: автор одного из тиктоков рассказал, что девушка, с которой он пошел на свидание, в ресторане спросила у ChatGPT, что ей заказать. То есть она не попыталась прочитать меню самостоятельно и выбрать то, что ей понравится, а просто делегировала это решение чат-боту. На второе свидание ее не пригласили.

Часто с помощью общения с чат-ботами люди действительно пытаются освободить себя от рутины. ChatGPT выбирает за них, что приготовить, как ответить на рабочее письмо и чем заняться в свободное время.

В крайней степени это может привести к тому, что человек перестанет доверять себе и собственным суждениям. Привычка всегда полагаться на готовый ответ будет мешать принимать решения самостоятельно. Со временем человек может начать видеть в чат-боте посредника между собой и реальностью.

Что в итоге

- ИИ-слоп — это низкокачественный контент, сделанный нейросетями, обычно без доработки человеком.

- Доступность ИИ-генераторов сделала массовым поток однотипных картинок, видео, мемов и текстов, созданных ради кликов и охватов.

- ИИ-слоп засоряет интернет, распространяет дезинформацию, снижает доверие к площадкам и ухудшает сами модели.

- Слопперы — это люди, которые постоянно советуются с ИИ, постепенно утрачивая привычку принимать решение самостоятельно.

- ИИ-слоп ускоряет превращение интернета в безликую коммерциализированную среду, где все реже встречается живое и искреннее.

Мы постим кружочки, красивые карточки и новости о технологиях и поп-культуре в нашем телеграм-канале. Подписывайтесь, там классно: @t_technocult