Как запретить ИИ обучаться на моих диалогах с ним?

Говорят, что нейросети обучаются на диалогах с пользователями и все мои данные из диалогов могут попасть им в память. Как сделать так, чтобы этого не происходило?

Большие языковые модели вроде ChatGPT, Claude, Gemini или Алисы обучаются на огромных массивах данных: текстах, картинках, таблицах, графиках и многом другом. Среди них есть и чаты самих нейросетей с пользователями.

Расскажу, в каких сервисах и как можно ограничить использование своей переписки для обучения нейросетей.

Какие данные собирают ИИ и зачем

Какие данные собирают чат-боты. В условиях использования сервиса, настройках приватности или справочном разделе обычно есть информация, какие ваши данные передадут разработчикам. Они немного различаются, но в целом это могут быть:

- Ваши запросы и ответы нейросети, загруженные документы, фотографии и код, который вы просите исправить.

- Оценки ответов — лайки и дизлайки под сообщениями чат-бота, по которым он определяет, хороший ответ или нет.

- Данные о вашем местоположении, IP-адресе, типе устройства, браузере, времени взаимодействия. Эту информацию собирает большинство приложений — не только чат-боты.

- Если нейросеть интегрирована в другое приложение, например браузер, почту или документы, она может получить доступ к документам, файлам или истории переписок для понимания контекста.

Зачем разработчикам нужны эти данные. Модели обучаются на диалогах с реальными пользователями. Это помогает ИИ лучше понимать нюансы человеческой речи, интонации, эмоции, специфический сленг и профессиональную терминологию. От этого ответы новых моделей становятся более адекватными и полезными. А еще нейросети учат распознавать вредоносный контент, попытки взломать алгоритм или создать что-то потенциально опасное.

Собранные данные всегда анонимизируют — лишают привязки к аккаунту, электронной почте и другим признакам, по которым можно идентифицировать пользователя. Те, кто потом работает с этой информацией, будь то люди или алгоритмы, не могут знать, какой набор данных к какому аккаунту относится.

Зачем ограничивать обучение чат-ботов на ваших данных. Если модель обучалась на диалогах с вами, злоумышленники могут воспроизвести информацию через специально подобранные промпты. По сути, заставить чат-бота повторять то, что вы ему говорили. Формально это будет просто текст, не привязанный к вашему аккаунту, но, если вы обсуждали там личные данные, по ним можно вас распознать.

Кроме того, некоторые компании хранят логи переписок от 18 месяцев до пяти лет или вообще бессрочно. А корпорации вроде Google или Microsoft объединяют данные из чат-ботов с информацией из других своих продуктов: поисковых запросов, покупок, активности в соцсетях. Так они дополняют ваш цифровой профиль.

Если ваши диалоги уже попали в обучающий датасет, удалить их оттуда не получится. Многие сервисы сохраняют данные по умолчанию — это нужно отключать вручную. Другие предлагают «улучшить опыт» — соглашаясь, вы разрешаете использовать ваши переписки для обучения модели.

Дальше расскажу, как ограничить использование данных в популярных нейросетях. Но запрет будет действовать только на новые чаты — все, что вы отправляли раньше, он не затронет.

В любом случае не стоит сообщать ИИ то, что вы не готовы показать посторонним: пароли, паспортные данные, медицинские документы, откровенные фото. Даже если обучение отключено, ваши диалоги могут какое-то время храниться на серверах компании, а в случае утечки стать публичными.

Как запретить ChatGPT обучаться на диалогах

Какие данные использует. OpenAI по умолчанию собирает запросы пользователя и ответы модели, если это не отключили в настройках. Так же передается информация о лайках и дизлайках. При этом чат-бот не хранит загруженные в диалоги картинки.

Причем, если пользователь запретил задействовать свои данные, но отреагировал на ответ модели, вместе с информацией об этом лайке может быть передан и весь прилагающийся к нему контекст.

Как ограничить:

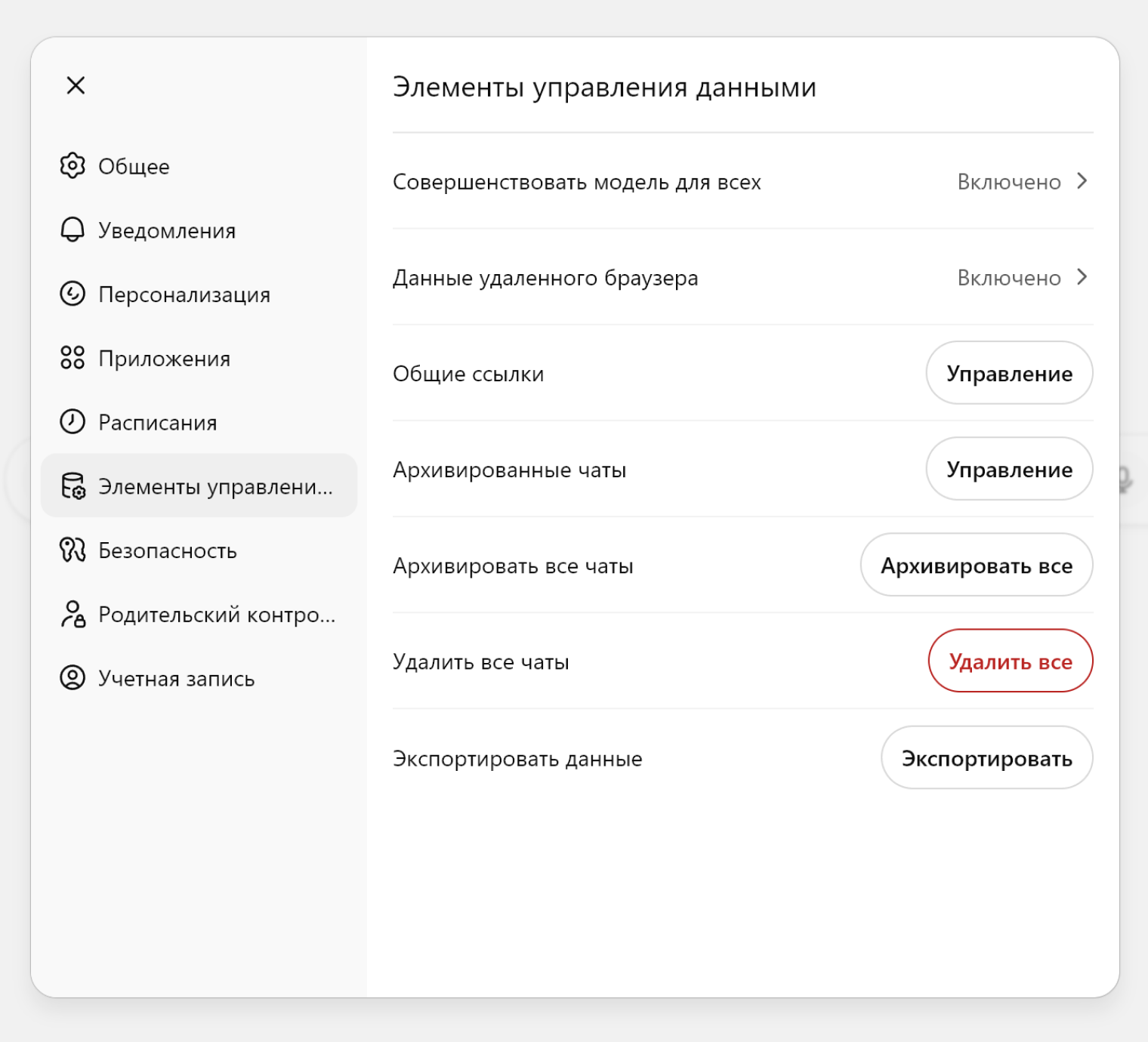

- Отключить использование ваших чатов для обучения ChatGPT. Зайдите в свой профиль → «Настройки» → «Элементы управления данными» → «Совершенствовать модель для всех». Там деактивируйте переключатели для всего контента, а также для аудио и видео, если надо.

- Использовать временные чаты. Они не сохраняются в истории и не используются для обучения.

- Не ставить лайки и дизлайки ответам модели в диалогах на чувствительные темы.

Весь контент, даже из временных чатов, все равно будет доступен OpenAI, но его обещают хранить только 30 дней и использовать для целей безопасности. Например, логи чатов могут предоставить правоохранительным органам, если того требует местное законодательство.

Как запретить Gemini обучаться на диалогах

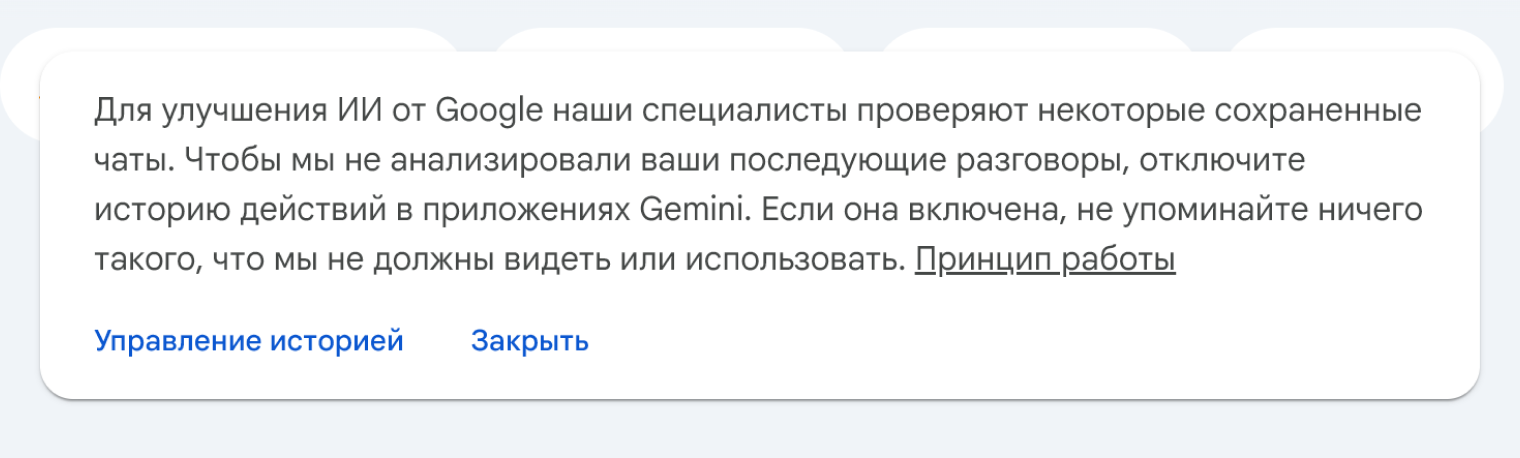

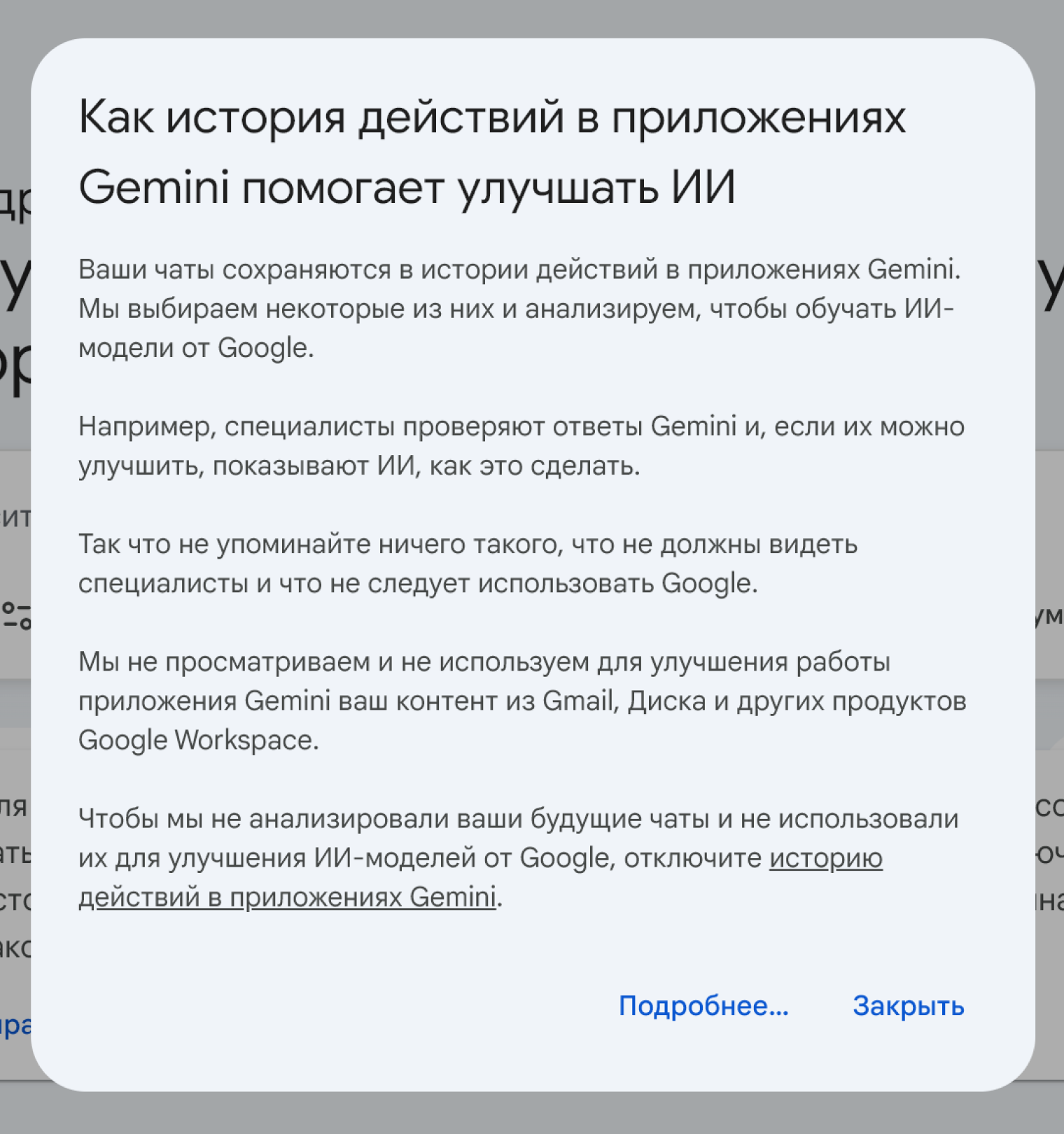

Какие данные использует. Google по умолчанию собирает информацию двух видов. Во-первых, это то, что вы напрямую сообщаете нейросети: тексты запросов, любые загруженные в диалог файлы, изображения или скриншоты, расшифровка аудиосообщений, названия и инструкции ваших Gem-ботов внутри сервиса и так далее.

Во-вторых, это данные, которые собирает сама система. Например, сгенерированный Gemini контент, сведения о ваших устройствах и браузере, ОС. Не стоит забывать и про разрешения, выданные мобильным приложениям. Например, функции Gemini фактически встроены в приложение Google для Android. Поэтому нейросеть использует те же системные разрешения, которые вы выдали основному приложению Google. Например доступ к электронной почте, файлам и фотографиям.

Как ограничить:

- Отключить функцию «Активность в приложениях Gemini». Для этого переключите тумблер с «Включено» на «Отключить». После этого чаты и диалоги перестанут сохраняться в аккаунте. Их не будут использовать для обучения модели, но у вас пропадет возможность продолжать старые диалоги и возвращаться к ним.

- Удалить существующие данные. Это можно сделать на той же странице — вместо «Отключить» выберите «Отключить и удалить историю». Но если ваш диалог уже попал в выборку, с которой работают редакторы при обучении нейросетей, из базы для обучения его уже не удалить.

- Использовать временные чаты. Можно сохранять историю в целом, но отдельные вопросы обсуждать во временных чатах — информация из них не передается разработчикам.

Данные из корпоративных и учебных аккаунтов не используют — только из личных.

Как запретить Claude обучаться на диалогах

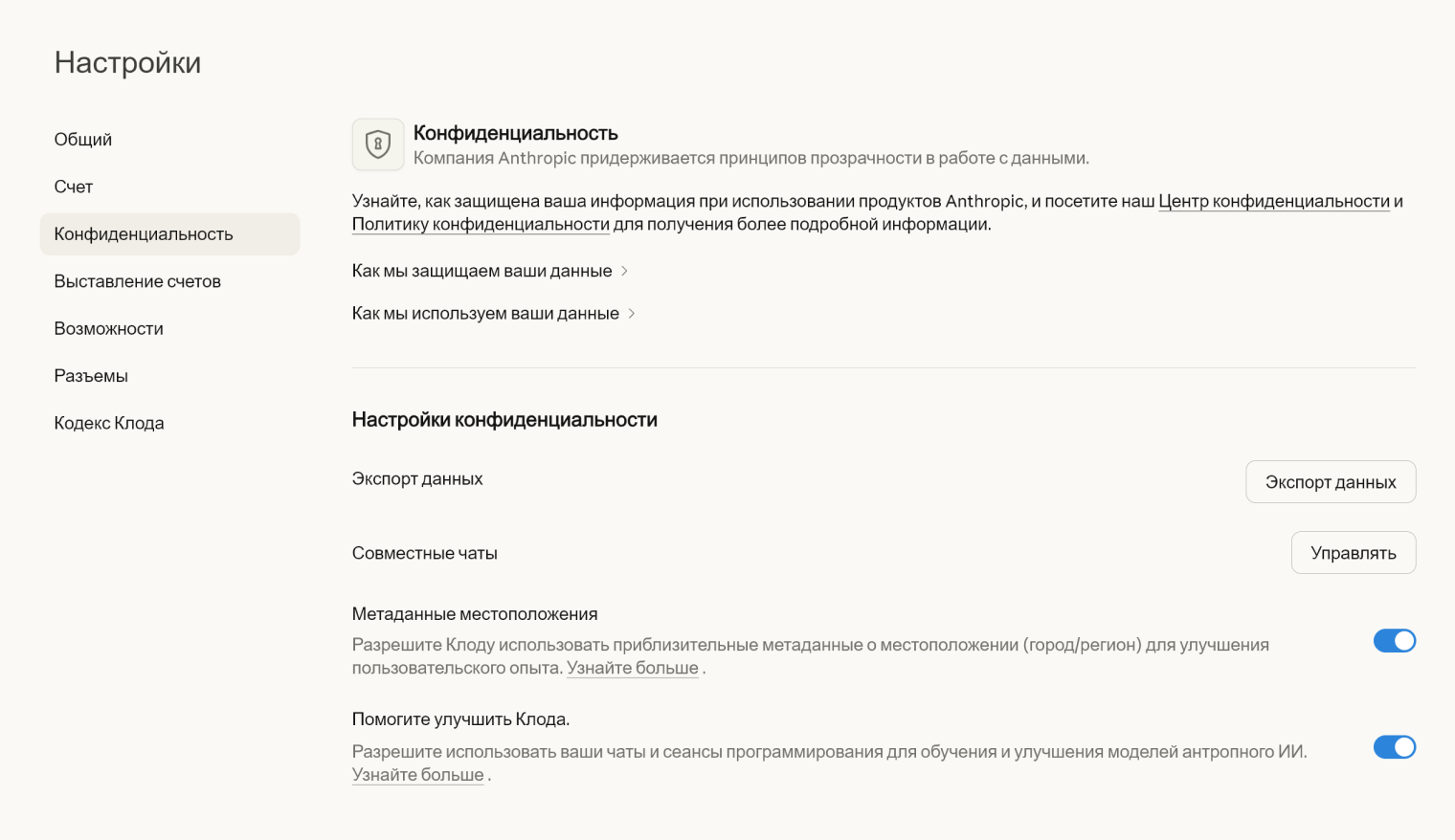

Какие данные использует. Anthropic собирает данные из всех чатов в личных аккаунтах по умолчанию, если пользователь это не запретил. В обучение попадает вся переписка целиком, включая загруженные файлы, пользовательские стили и настройки диалогов. Данные используют в анонимизированном виде.

До осени 2025 года компания не обучала модели на данных пользователей, поэтому старые чаты не должны были попасть в датасеты в любом случае. А вот новые диалоги и возобновленные старые — уже да. Корпоративных аккаунтов это не касается.

Как ограничить: отключить использование своих данных для улучшения модели в настройках профиля. Откройте меню «Настройки» → «Конфиденциальность» → «Настройки конфиденциальности» → выключите опцию «Помогите улучшить Claude».

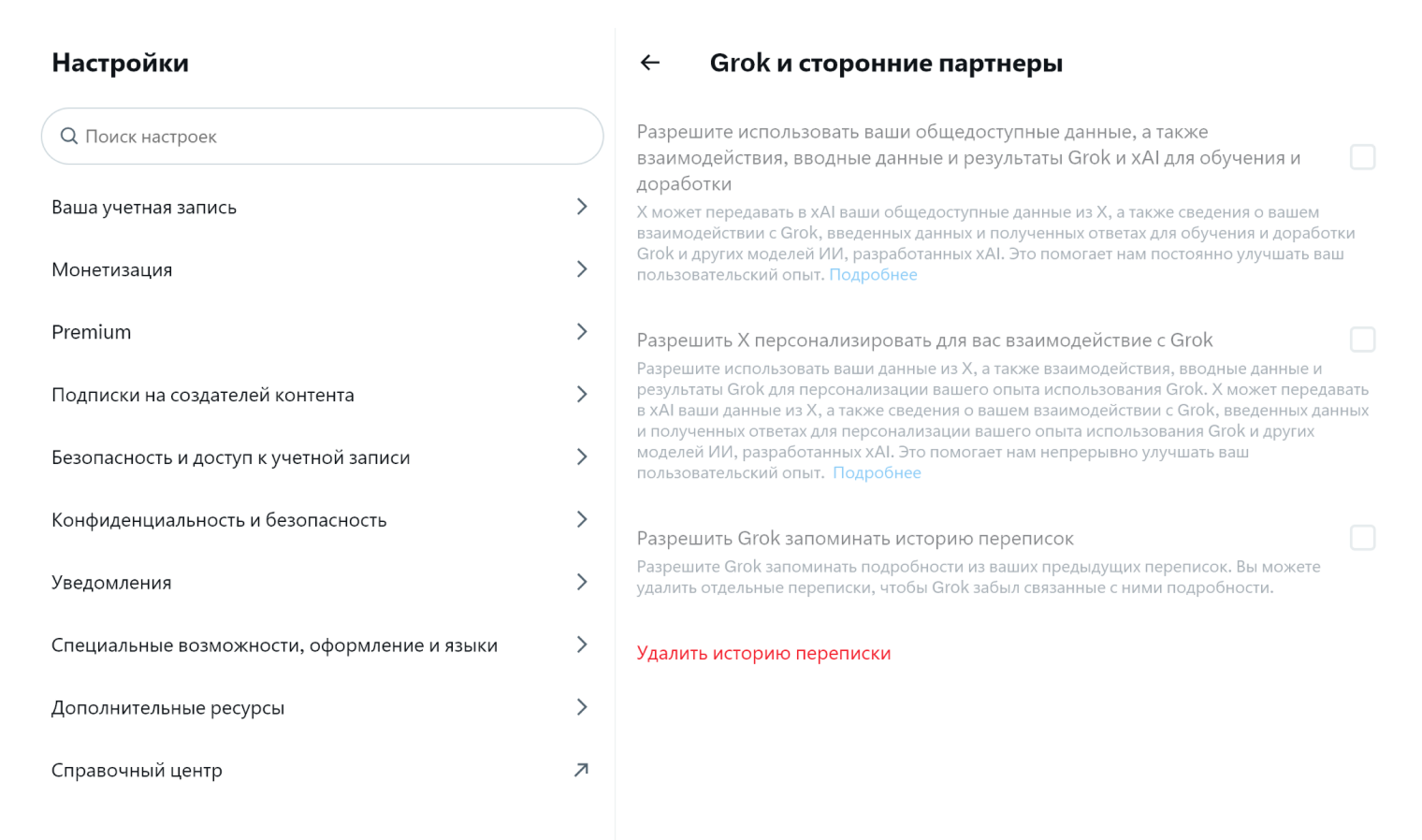

Как запретить Grok обучаться на диалогах

Какие данные использует. Нейросеть Grok, разработанная компанией Илона Маска xAI, активно обучается на данных пользователей соцсети X (бывший «Твиттер»). Система использует публичные посты и личное взаимодействие с чат-ботом.

Из публичных данных разработчики берут для обучения сами посты в соцсети X, репосты и другие взаимодействия с пользователями. Из диалогов с Grok используют и запросы, и ответы системы, и реакции на ответы нейросети. Плюс метаданные — информацию о том, как часто, через какие приложения и с какими задачами вы обращаетесь к ИИ.

Как ограничить:

- Отключить сбор данных в настройках профиля. Это можно сделать в меню «Настройки и конфиденциальность» → «Конфиденциальность и безопасность» → «Grok и сторонние партнеры».

- Удалить историю диалогов на той же вкладке.

- Сделать аккаунт в X приватным. Тогда посты не будут использоваться для обучения Grok, так как модель ориентирована прежде всего на публично доступный контент.

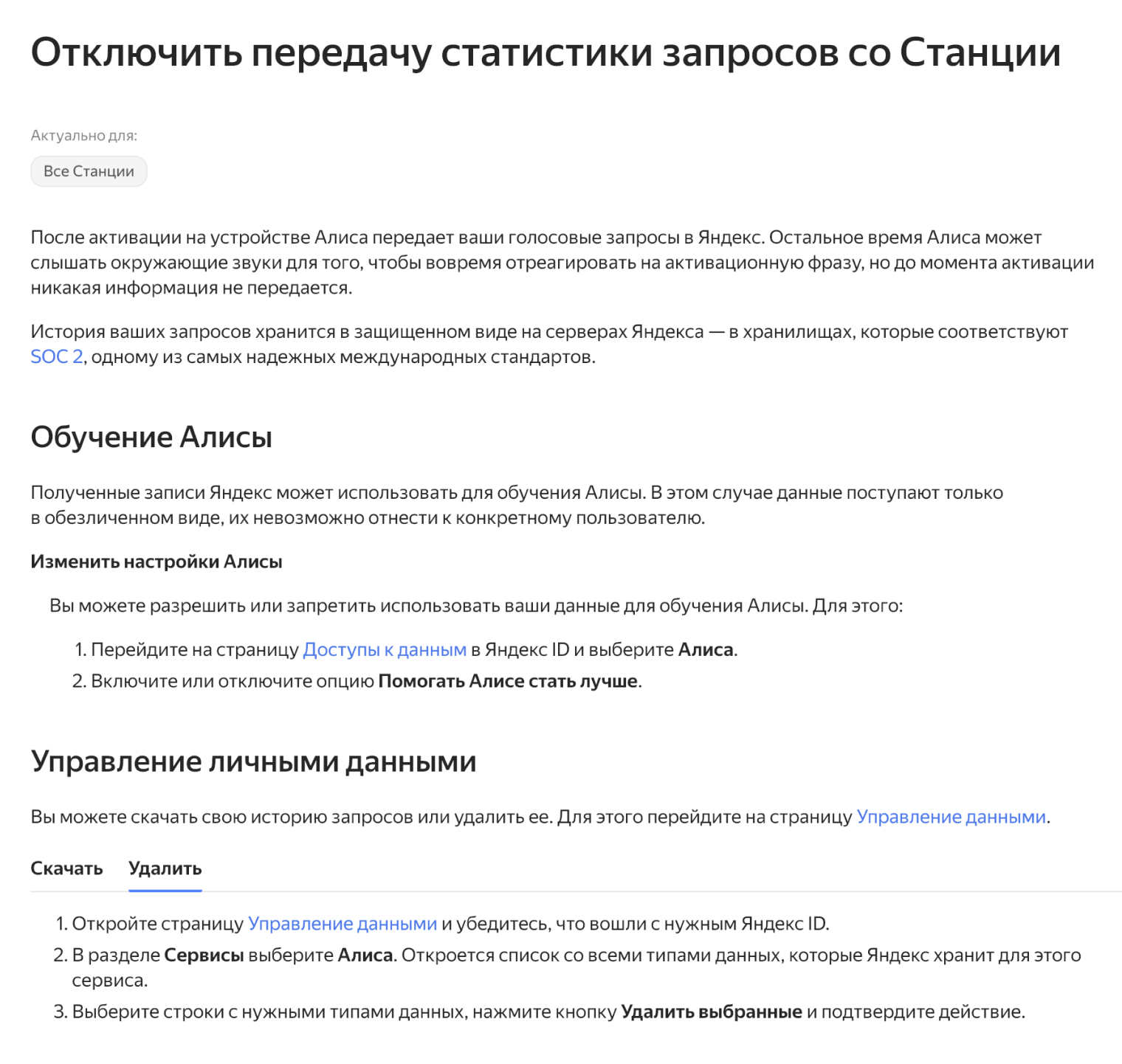

Как запретить Алисе обучаться на диалогах

Какие данные использует. Алиса по умолчанию передает аудиокоманды в Яндекс, чтобы научиться лучше понимать акценты, дикцию и отделять фоновые шумы, запоминает историю переписки в чате и информацию о типе устройства, городе, времени запроса и о том, какое приложение открыли. Также для обучения используют лайки и дизлайки под ответами чат-бота. При этом все данные используют в обезличенном виде.

Как ограничить:

- Отключить передачу данных для обучения. В настройках Яндекс ID перейдите в раздел «Данные» → «Доступы к данным» и посмотрите настройки для всех сервисов. Например, можно деактивировать опцию «Помогать Алисе стать лучше».

- Удалить историю запросов в настройках Яндекс-станции.

- Сбросить голосовой профиль Voice ID. Если вы настраивали узнавание по голосу, сервис хранит его слепок. Его можно удалить в приложении «Дом с Алисой». Для этого выберите колонку → «Мой голос» → «Забыть мой голос».

Но если данные уже попали в обучающую выборку в анонимизированном виде, они там останутся.

Как запретить GigaChat обучаться на диалогах

Какие данные использует. Сбер тоже использует данные, которые возникают в процессе вашего взаимодействия с нейросетью, а именно тексты диалогов: и ваши запросы, и ответы чат-бота, лайки и дизлайки. Перед попаданием в обучающую выборку персональная информация должна анонимизироваться.

Как ограничить: никак. В интерфейсе GigaChat и мобильного приложения нет настроек, чтобы управлять своими данными или их использованием. В документе «Соглашение об использовании сервиса GigaChat для физических лиц» пишут, что клиент предоставляет Сберу весь свой контент на условиях безвозмездной безотзывной лицензии по всему миру.

Также в GigaChat нет возможности создать временный или анонимный диалог, который не будет сохраняться в истории.