Как мы проверили 1000 сотрудников и поняли, какие компетенции измеряют компании

Этот текст написан в Сообществе, в нем сохранены авторский стиль и орфография

О Сообщнике Про

Руковожу продуктовым развитием FoxTailBox — платформы для автоматизации оценки сотрудников и кандидатов с помощью ИИ. Работаю на стыке HRTech, EdTech, B2B- и ИИ-продуктов.

Это новый раздел Журнала, где можно пройти верификацию и вести свой профессиональный блог.

Кейс проектов оценки сотрудников, ошибки корпоративных диагностик и выводы для бизнеса

В этом году мы завершили несколько крупных проектов по оценке персонала. Так совпало, что к марту одновременно закрылись сразу несколько исследований в очень близкой тематике, и в итоге у нас на руках оказалась довольно редкая для рынка выборка данных.

Мы проводили оценки для корпоративного университета Синергии, где оценивали команды разработки, совместно с ФРИИ — специалистов в контуре Альфа-Банка, а также вместе с партнерами из стран СНГ — управленческие команды крупных производственных и добывающих компаний. В сумме это дало данные по более чем 1000 сотрудникам интеллектуального труда.

В выборку попали разработчики, аналитики, менеджеры, управленцы разных уровней, а в ряде случаев — целые команды и филиалы. То есть классические белые воротнички. Именно поэтому мы решили посмотреть на эти данные не как на набор отдельных кейсов, а как на срез современного рынка оценки компетенций на 2026 год. И результаты, честно говоря, оказались довольно неожиданными.

В этой статье я попробую разобрать четыре вещи: кого, что и как мы оценивали, какие ошибки чаще всего происходят в корпоративных оценках, какие результаты мы получили в цифрах и какие выводы из этого можно сделать для HR, бизнеса и руководителей функциональных направлений.

Сразу оговорюсь: часть данных попадает под NDA, поэтому я не могу раскрывать конкретные результаты отдельных компаний. Но все цифры, диаграммы и выводы в статье основаны на реальных данных проектов. При этом особенно интересно, что данные, полученные нами в IT, финтехе, логистике, производстве, добыче и консалтинге, между собой отличаются крайне незначительно.

Это позволяет говорить не столько о специфике отдельных отраслей, сколько о глобальном сдвиге в компетенциях интеллектуальных профессий. По крайней мере, в тех white-collar ролях, с которыми мы работали, различия между нишами оказываются слабее, чем общий эффект от изменения самой среды труда.

Кого и как мы оценивали

Начнем с одного из последних проектов. Мы завершили оценку компетенций сотрудников для корпоративного университета Синергии, и отдельно хочется сказать: с этой командой было очень приятно работать. Настолько оперативная работа, честно говоря, довольно необычна для проектов такого масштаба. Побольше бы таких профессионалов.

Мы согласовали все аспекты буквально за две часовые встречи. От первичной демонстрации платформы до запуска проекта нам потребовалось всего две встречи, на которых удалось объяснить, как работает система оценки, согласовать объем задач, определить роли и ответственных, договориться о сроках, утвердить организацию процесса и закрыть вопросы по договору и смете.

Для компании такого масштаба это очень высокий уровень проектной организации. В нашей практике бывают случаи, когда подобные согласования длятся месяцами, иногда — больше полугода. Здесь же все заняло буквально несколько часов.

Масштаб работы внутри проекта

После запуска началась подготовка самой системы оценки.

Естественно, диагностика строилась на комбинации hard- и soft-skills — это уже базовый стандарт современной оценки компетенций. При этом hard-компетенции формировались под конкретные роли, а soft-компетенции — под типы организационных функций: отдельно для тех, кто работает с людьми, отдельно для тех, кто работает с процессами, и отдельно для специалистов, которые в основном взаимодействуют с системами и технологиями.

В рамках проекта было подготовлено более 20 карт компетенций, после чего команда заказчика выбрала 10 финальных моделей, которые и легли в основу диагностики. Чтобы было понятнее, что это за масштаб: в рамках проекта было создано более 5000 вопросов — от софтовых кейсов и управленческих ситуаций на несколько страниц текста до базовых технических тестов по PHP и другим технологиям.

И все это было собрано и согласовано буквально за два дня работы проектной команды. Поэтому здесь действительно хочется еще раз поблагодарить проектный офис Синергии: коллеги выходили на связь после 19:00 и даже в выходные, чтобы оперативно согласовывать правки и не тормозить процесс.

Второй источник данных — проекты с ФРИИ

Второй крупный блок данных появился в рамках проектов, которые мы делали совместно с ФРИИ. В этих проектах роли были разделены: мы выступали как эксперты по автоматизации оценки, AI-проверке ответов и аналитике результатов диагностики, а команда ФРИИ занималась методологией оценки, взаимодействием с заказчиком, валидацией моделей компетенций, корректировкой критериев и сопровождением проекта со стороны бизнеса.

Это была очень плотная совместная работа. В какой-то момент мы сделали более 20 итераций донастройки системы, чтобы приблизить качество автоматической оценки к уровню экспертной проверки. Этот опыт оказался крайне полезным: он позволил увидеть, как ведут себя реальные сотрудники на диагностике, где возникают искажения в данных и в каких точках автоматизированная система начинает расходиться с человеческой оценкой.

Дополнительные проекты в промышленности и управлении

Помимо этих двух крупных направлений, мы провели еще несколько оценок вместе с партнерами из стран СНГ. Это были проекты оценки управленческих команд, производственных специалистов топ-уровня, руководителей подразделений и линейных руководителей — например, начальников смен и участков на предприятиях — в крупных производственных и добывающих компаниях.

Интересно, что несмотря на различие отраслей — от IT и финтеха до промышленности — паттерны поведения сотрудников на оценке оказались удивительно похожими. Именно поэтому мы решили агрегировать результаты нескольких проектов и посмотреть на них как на единый массив данных.

Итоговая выборка

Если объединить все проекты, которые завершились за последние месяцы, получается массив данных примерно из 1000 оценок специалистов интеллектуального труда. В выборке — разработчики, аналитики, менеджеры и руководители разных уровней. В основном это сотрудники уровня middle и senior, работающие в крупных компаниях.

И уже сама эта выборка больше, чем большинство организаций когда-либо анализировали у себя. Именно на таких масштабах аналитики начинают проявляться системные ошибки корпоративных оценок, потому что становятся видны отчетливые паттерны и закономерности — не просто по отдельному отделу, а по целой отрасли.

Какие ошибки мы встретили при реализации проектов оценки

Когда смотришь на один проект оценки, многие вещи могут выглядеть как частные проблемы конкретной компании. Но когда подобных проектов становится несколько, и через систему проходит сотни и тысячи сотрудников, начинают проявляться довольно устойчивые закономерности. Причем эти закономерности повторяются в разных индустриях — в IT, финтехе, производстве, логистике и консалтинге.

Ниже — основные ошибки, с которыми мы сталкивались практически в каждом крупном проекте оценки.

1. Нереалистичные сроки

Самая частая проблема — недооценка масштаба проекта. Со стороны многим кажется, что оценка сотрудников — это довольно простая задача: придумать несколько вопросов, загрузить их в систему, прогнать сотрудников и получить результаты. На практике полноценная система оценки включает разработку карт компетенций, формирование моделей навыков, генерацию вопросов, разработку кейсов, создание критериев оценки, тестирование системы и калибровку результатов.

Даже при использовании AI-инструментов это очень большой объем работы. Но в реальности проекты часто пытаются запустить в режиме «давайте сделаем что-нибудь за неделю». Это почти неизбежно влияет на качество диагностики, потому что часть методологической работы приходится либо резко ужимать, либо переносить на подрядчика.

2. Оценка, оторванная от реальной работы

Вторая распространенная проблема — задания, которые никак не связаны с реальными задачами сотрудников. Иногда заказчик хочет проверить не реальные компетенции, а собственное представление о том, какими эти компетенции должны быть. В результате появляются задания, которые сотрудники никогда не решают в реальной работе.

Например, можно придумать блестящее техническое интервью уровня Microsoft. Но если компания — небольшая региональная организация, где задачи намного проще, сотрудник с таким уровнем компетенций просто окажется пятым колесом в телеге. Поэтому строить систему оценки на кейсах, которые никогда не встречаются в реальной практике компании, — это не строгость, а методологическая ошибка.

3. Попытка измерять старые метрики

Еще одна типичная история — перенос в новые системы оценки подходов из старых корпоративных экзаменов. Многие организации десятилетиями проверяли, насколько хорошо сотрудник знает регламенты, внутренние инструкции, корпоративные документы, положения и уставы. Но возникает простой вопрос: что именно это измеряет.

Очень часто — ничего, кроме памяти и привычки к корпоративной муштре. Это не показывает способность решать задачи, принимать решения и работать с неопределенностью. А значит, такой формат может создавать иллюзию контроля, не давая бизнесу почти никакой полезной информации о реальной работоспособности сотрудника.

4. Желание проверить всё сразу

Еще одна частая ситуация — попытка включить в оценку максимально полный список компетенций. Логика обычно звучит примерно так: «Мы хотим проверить весь спектр навыков сотрудника». Без проблем. Но тогда полноценная диагностика действительно будет занимать десятки часов.

Если реально проверять знания, навыки, аналитическое мышление, управленческие компетенции и soft skills, то полноценная оценка может занять до 40–50 часов работы. Но в большинстве случаев компании хотят получить глубокую диагностику по всем компетенциям за один час тестирования. В такой ситуации приходится выбирать: либо тесты — быстро, но можно угадать; либо кейсы — точнее, но намного дольше.

5. Делегирование валидации самим сотрудникам

Еще одна распространенная проблема — попытка отдать валидацию вопросов тем же сотрудникам, которые потом будут проходить оценку. В теории это выглядит логично: кто лучше знает работу, чем сами специалисты. Но на практике включается простой человеческий фактор.

Если у человека есть возможность упростить задания, убрать сложные кейсы и заменить их тестами, то часто именно так и происходит. Не потому что люди плохие, а потому что никто не хочет усложнять себе жизнь без необходимости. В результате система оценки начинает смягчаться еще до запуска.

6. Огромные кейсы в эпоху ChatGPT

Еще одна интересная проблема последних лет — гигантские кейсы. Некоторые компании считают, что если сделать задание на несколько страниц текста, то сотрудник точно будет решать его самостоятельно. Но в эпоху генеративного ИИ это работает наоборот: чем длиннее кейс, тем выше вероятность, что человек просто отправит его в ChatGPT.

То есть сама попытка «усложнить жизнь» сотруднику иногда приводит к обратному эффекту. Вместо диагностики мышления компания получает проверку того, насколько человек быстро и без стыда умеет пользоваться нейросетью.

7. Попытка спорить с результатами на уровне интуиции

Это один из самых интересных эффектов. Иногда после оценки появляется реакция: «Этого не может быть». Например: «У нас есть сотрудник Петя. Он отличный специалист. Почему он получил низкий результат?»

Но система оценки не знает, какой Петя человек, насколько он приятен в общении и как давно работает в компании.

Она анализирует только вопросы, ответы и критерии оценки. И если ответы не соответствуют критериям, результат будет низким. В этом смысле спорить с результатом на уровне личного впечатления — все равно что спорить с градусником, потому что больной кажется бодрым.

8. Попытка калибровать систему на двух ответах

И, пожалуй, самый распространенный кейс. Прошли оценку два сотрудника, после чего начинается обсуждение: «Нам кажется, система занижает результаты». Но корректная калибровка моделей оценки требует большого массива данных. В наших проектах стабильность критериев начинает проявляться примерно после 100–150 прогонов.

Поэтому делать выводы на основании двух или трех тестирований просто невозможно. На таких объемах вы видите не поведение системы, а случайные колебания выборки и эмоциональную реакцию конкретных участников.

Откуда берутся эти ошибки

Большинство этих проблем возникает не из-за злого умысла. Они возникают из-за того, что многие компании до сих пор не представляют, как устроена современная система оценки полного цикла. Сегодня она включает генерацию карт компетенций, разработку вопросов и кейсов, создание критериев оценки, автоматическую проверку ответов и формирование аналитических отчетов.

При этом эксперты компании участвуют не в проверке каждого ответа, а в валидации модели оценки. И именно так сегодня работают системы, которые уже проверены на тысячах сотрудников.

Но организационные ошибки — это только часть проблемы. Когда мы начали смотреть не на процесс, а на сами результаты диагностики, стало видно, что меняется не только качество проектов оценки, но и сама структура компетенций сотрудников.

Какие результаты мы получили в цифрах

1. Большинство сотрудников уже работают в режиме «человек + ИИ»

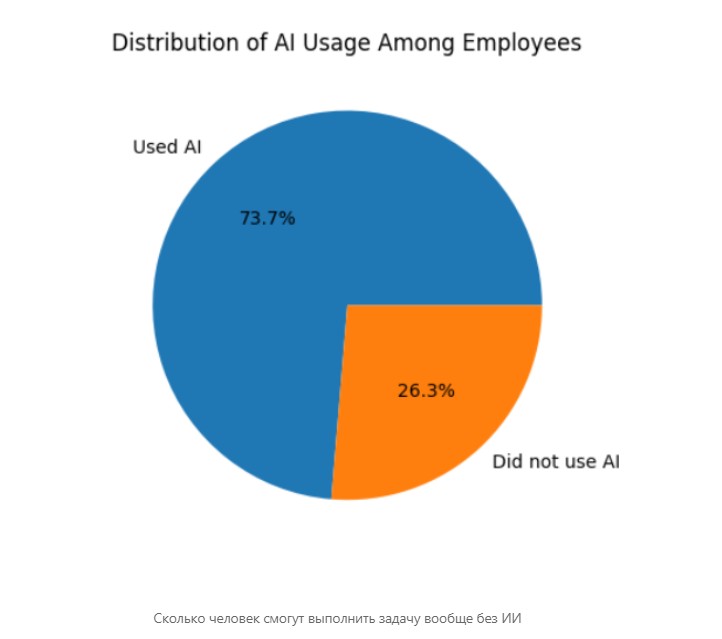

Если смотреть на блоки технических, аналитических и управленческих заданий, картина выглядит примерно так: 59% сотрудников использовали ИИ хотя бы в одном задании, 21% прошли задания полностью самостоятельно, еще 20% дали неоднозначную, неполную или пограничную картину.

Если перевести это на выборку из 1000 человек, получается, что 590 активно применяют ИИ, 210 работают полностью автономно, а 200 находятся в серой зоне. То есть примерно три четверти специалистов уже существуют в гибридном режиме работы. И важно понимать: это не стажеры, не студенты и не джуны. Это опытные сотрудники, которых крупные компании уже давно отобрали, вырастили и встроили в свои процессы.

2. Только четверть специалистов способны пройти сложные задания полностью без ИИ

Если смотреть не просто на факт использования инструментов, а на поведение внутри задач, картина становится еще интереснее. Около 60% сотрудников хотя бы раз опирались на ИИ в процессе решения, а весь блок полностью самостоятельно проходили только 25–30%.

В пересчете на 1000 сотрудников это означает, что 600 человек периодически используют ИИ в процессе работы, а 250–300 способны пройти сложные задания без него. И это уже очень важный сигнал. Потому что автономная компетентность становится редкостью — не в том смысле, что люди резко стали хуже, а в том, что сама рабочая среда изменилась настолько, что навык «делать все самому» перестает быть нормой.

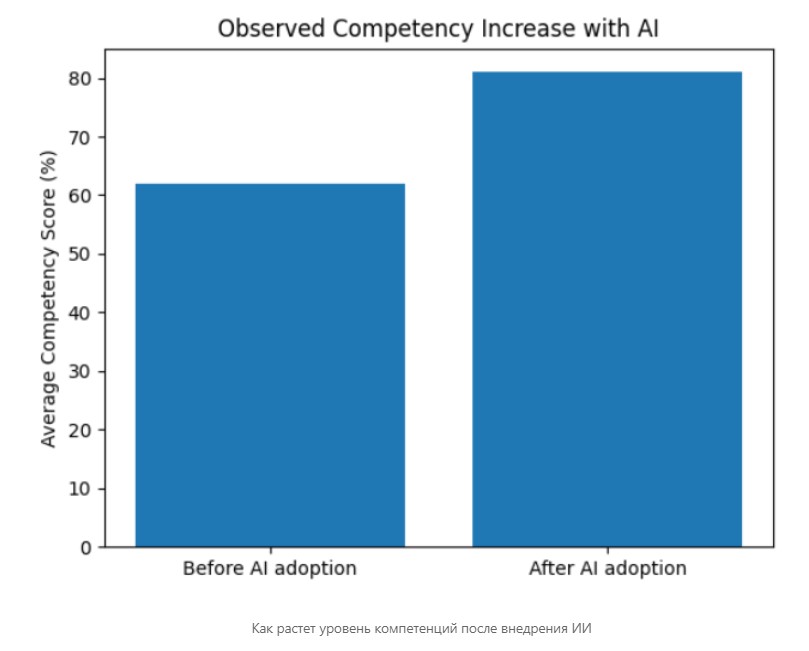

3. ИИ поднимает средний уровень команды, но меняет сам конструкт компетенций

Если смотреть на динамику результатов за последние два года, мы видим очень резкий рост среднего уровня. В одной из диагностик средняя проявленность компетенций выросла с 62% до 81%. Если привести распределение к модели на 1000 человек, получится примерно следующая картина: около 700 выглядят как Senior, около 300 — как Middle, а Junior практически исчезает.

На бумаге это выглядит как фантастический апгрейд команды. Но проблема в том, что это не всегда означает, что люди настолько же усилились сами по себе. Это означает, что ИИ достраивает базовую экспертизу, сглаживает слабые зоны и помогает сотруднику выглядеть сильнее в тех задачах, которые раньше были хорошим маркером уровня. И вот тут начинается самое интересное: мы видим не просто рост баллов, а изменение самого измеряемого конструкта.

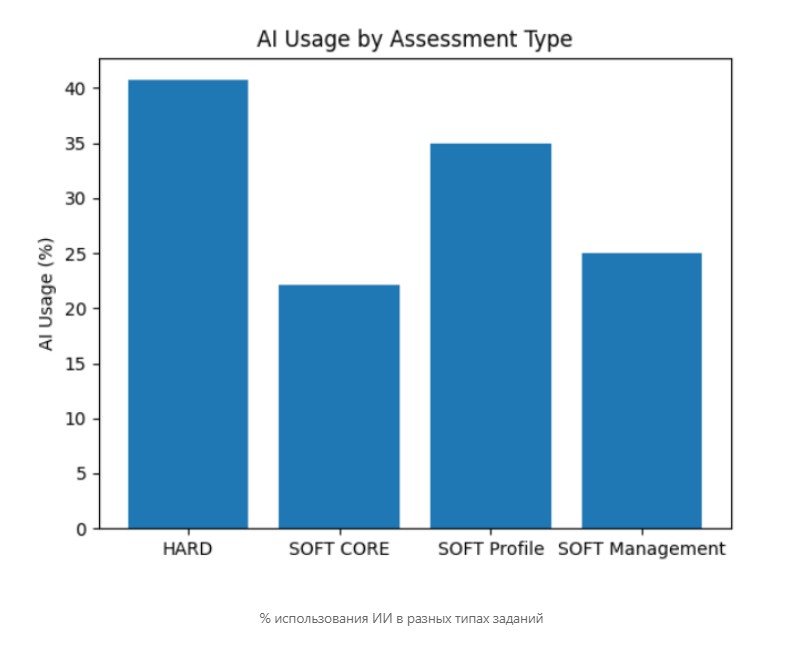

4. Где ИИ усиливает сотрудников сильнее всего

По разным проектам максимальный рост мы видели в задачах, связанных с анализом данных, структурированием информации, стратегическим мышлением, финансовой и продуктовой аналитикой, а также формулированием логики решения. В некоторых блоках рост достигал +30 процентных пунктов.

Это именно те зоны, где ИИ хорошо снимает так называемый базовый аналитический барьер. Раньше человеку нужно было самому долго считать, агрегировать, строить структуру и удерживать в голове взаимосвязи. Теперь значительная часть этой нагрузки передается инструменту. Именно поэтому средние сотрудники начинают демонстрировать результат, который раньше был характерен для более сильного уровня.

5. Где ИИ почти не помогает

Есть и обратная сторона. Некоторые компетенции растут заметно слабее. Иногда почти не растут вообще. Речь идет о проведении исследований, работе с пользователями, проверке гипотез, понимании рынка, полевых экспериментах и вообще работе с неоднозначной, неполной и живой реальностью.

ИИ может помочь сформулировать идею, красиво оформить гипотезу и даже подсказать шаблон исследования. Но он не заменяет реальное взаимодействие с системой, продуктом и людьми. Именно поэтому такие зоны становятся новой точкой различия между просто «нормальным сотрудником» и действительно сильным специалистом.

6. Мы перестаем измерять то, что раньше считалось ключевым

Исторически мы оценивали, кто лучше считает, кто лучше анализирует, кто лучше структурирует информацию, кто лучше оформляет решения и кто лучше пишет документы и делает презентации. Но проблема в том, что сегодня все это все чаще выполняют интеллектуальные системы.

И тут начинается очень неприятный для бизнеса момент. В оценках до сих пор живут задания из старого мира: оформи решение, структурируй ответ, подготовь презентацию, распиши подход по методике А или Б. Раньше это были полезные задания. Теперь это все чаще задания на тему: умеет ли человек нормально пользоваться нейросетью. То есть диагностическая ценность таких форматов падает.

В одном из кейсов мы видели буквально абсурдную ситуацию: человек получил 5 баллов из 100, но при этом система показала 100% вероятности использования ИИ. То есть сотрудник даже с внешним интеллектуальным протезом не смог выдать убедительный результат. Это очень показательный пример. ИИ не просто усиливает. Он еще и вскрывает людей, которые потеряли контур контроля.

7. Новая точка различия между Middle и Senior

В ближайшие годы нас будет интересовать уже не то, кто лучше делает типовую интеллектуальную работу в вакууме. Нас будет интересовать, умеет ли человек формулировать задачу, работать с интеллектуальными инструментами, а не просто копировать из них ответ, проверять выводы ИИ, находить ошибки в алгоритмах, держать метакогнитивный контроль, принимать решения в условиях, где нет готового шаблона, и собирать решение на стыке нескольких областей — то есть обладать архитектурным мышлением.

Это уже не про то, кто «лучше считает». Это про то, кто способен управлять интеллектом системы.

8. Почему это важно для компаний

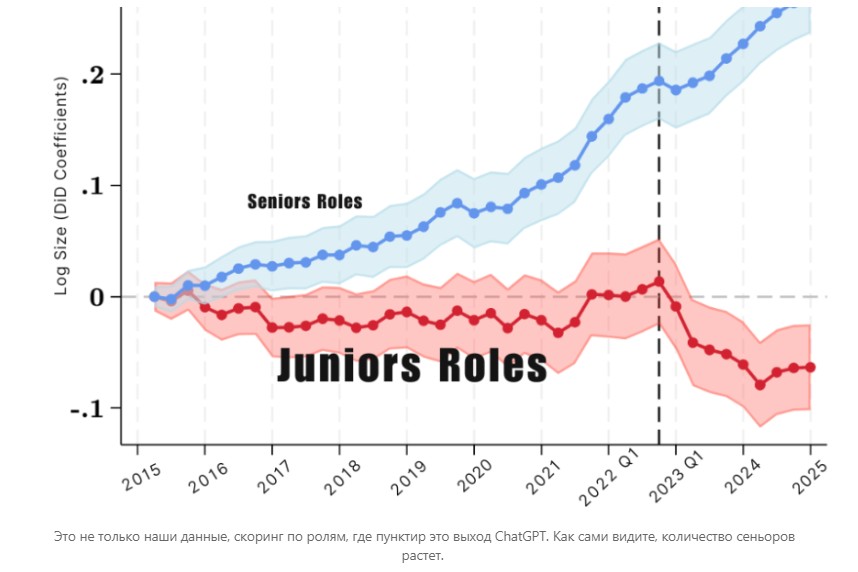

Если компания продолжает оценивать сотрудников по старым маркерам, она начинает получать искаженную картину. Получается, что Middle выглядит как Senior, Senior начинает выглядеть как Lead, а Junior почти исчезает. При этом реальная сложность профессии не уменьшается, а только растет.

То есть внешне команда как будто резко усилилась, но внутри этого усиления смешиваются две разные вещи: реальный рост компетентности и рост за счет интеграции инструмента. Это не временный шум и не «мода на ChatGPT». Это экологический сдвиг профессий — примерно такой же, как когда-то случился с компьютерами, калькуляторами, Excel и поисковыми системами.

Когда-то важным навыком было быстро писать от руки. Потом пришли компьютеры, и этот навык просто перестал быть маркером качества. Сейчас то же самое происходит с целым классом интеллектуальных задач.

9. Что делать дальше

Если компания хочет не догонять изменения, а использовать их себе в плюс, ей придется перестраивать систему оценки.

На практике это означает как минимум следующее: признать, что конструкт профессий изменился, пересобрать систему грейдов, разделить автономную компетентность и компетентность в среде «человек + ИИ», включить в критерии метакогнитивный контроль, устойчивость и глубину модели, отказаться от части оформительских заданий как от псевдодиагностики, разработать двухконтурную модель оценки и запускать пилоты новой методологии уже сейчас, а не через три года.

Компании, которые сделают это первыми, смогут не просто адаптироваться. Они смогут задать новый стандарт рынка.

В заключение

Мы больше не измеряем, кто лучше считает. Мы измеряем, кто способен управлять интеллектом системы. И если пересобрать методологию оценки сейчас, можно стать организацией, которая формирует новый стандарт, а не догоняет его через несколько лет.