24 апреля DeepSeek выложила в открытый доступ две версии новой модели — V4-Pro и V4-Flash.

Они доступны в виде открытого исходного кода, для разработчиков — через API. Их превью-версии можно бесплатно попробовать в чат-боте DeepSeek. V4-Flash работает через режим Instant, а V4-Pro — через Expert. Расскажу подробнее, что умеет новое поколение моделей.

Поколение V4 построено на архитектуре Mixture of Experts. Модель разбита на множество «экспертов» со своими знаниями о мире. На каждый запрос активируется только часть, которая релевантна задаче. Остальные в это время не задействуются.

Старшую, V4-Pro, обучили на 1,6 трлн параметров, но при ответе на запрос активируются только 49 млрд. Младшую, V4-Flash, — на 284 млрд параметров, а при запросе активируются 13 млрд. Поэтому, несмотря на огромный размер, модели отвечают быстро.

V4-Pro и V4-Flash могут работать как в «рассуждающем» режиме, так и без него.

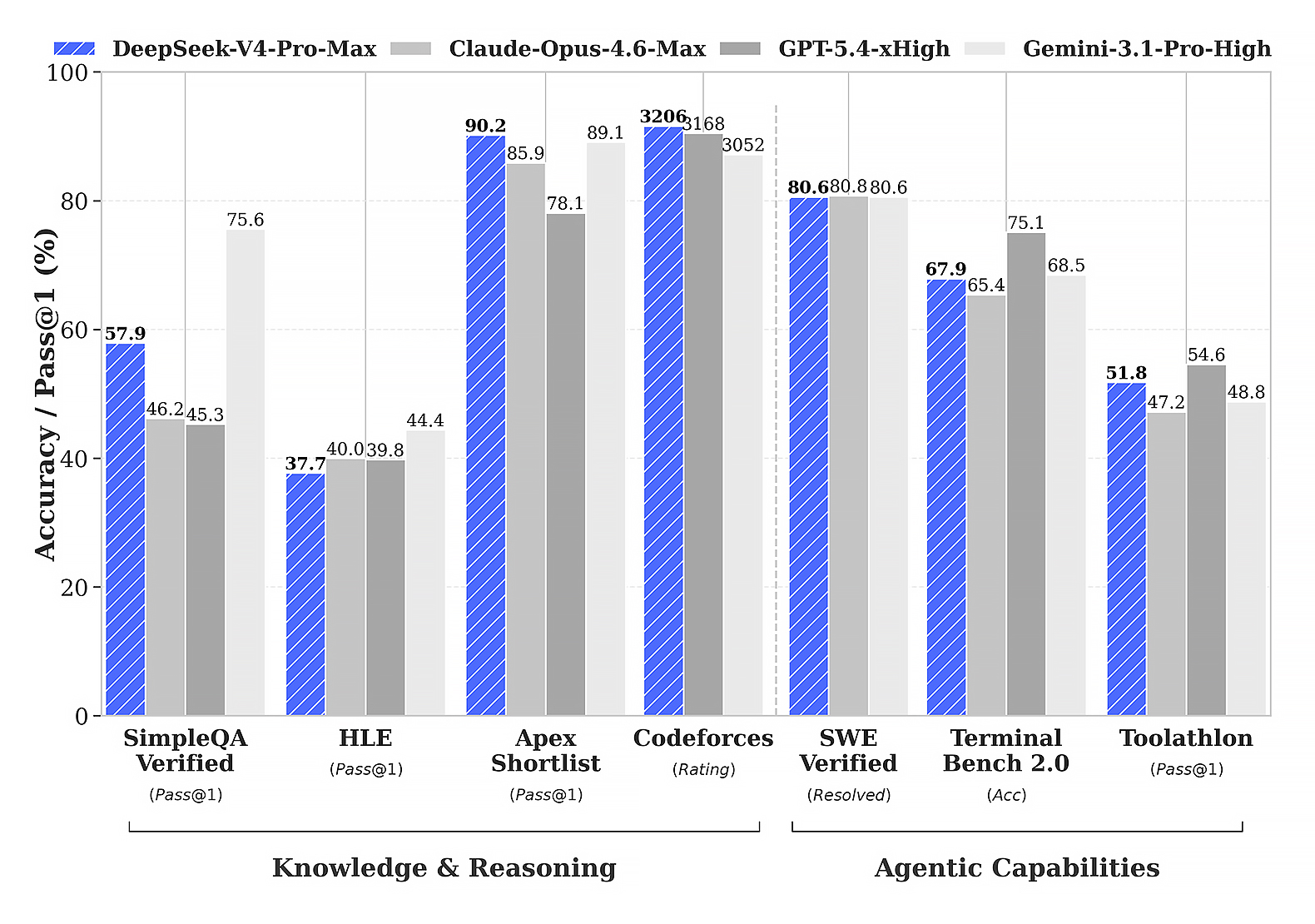

DeepSeek-V4-Pro обходит Claude Opus 4.6 и GPT-5.4. Она лучше всех среди моделей с открытым кодом справляется с агентными задачами, математикой, программированием и естественным наукам, заявляют разработчики со ссылкой на внутренние тесты. По объему общих знаний о мире она уступает закрытой модели Gemini-3.1-Pro.

DeepSeek-V4-Flash — младшая версия V4-Pro. Она быстрее отвечает на запросы и дешевле при использовании через API. С простыми задачами справляется на том же уровне, что и V4-Pro, но уступает в общих знаниях о мире и сложных агентных задачах.

Обе модели работают с большим объемом контекста. Они поддерживают контекст в 1 млн токенов — это означает, что им можно отправлять огромные куски текста или кода.

В DeepSeek решили проблему долгой обработки контекста через сжатие. Модель не обрабатывает каждый токен одинаково: менее важные она сжимает, на важных фокусируется полнее.

Обе модели поддерживают интеграцию с инструментами разработки. Среди них — Claude Code, OpenClaw и OpenCode.

DeepSeek стал популярен в конце 2024 года после выхода бесплатной опенсорсной модели V3, которая обошла в тестах конкурентов OpenAI и Google. При этом денег на обучение разработчики потратили намного меньше. В январе 2025 года вышла «рассуждающая» открытая модель R1, которая показала сопоставимые результаты с ChatGPT, Gemini и Claude.

Мы постим кружочки, красивые карточки и новости о технологиях и поп-культуре в нашем телеграм-канале. Подписывайтесь, там классно: @t_technocult